10 BESTE testdata Generator Verktøy (2026)

Har du noen gang følt deg fastlåst når verktøy av dårlig kvalitet har bremset testprosessen din? Å velge feil verktøy fører ofte til upålitelige datasett, tidkrevende manuelle rettelser, hyppige feil i arbeidsflyter og til og med dataavvik som sporer av hele prosjekter. Det kan også føre til samsvarsrisiko, inkonsekvent testdekning, sløsing med ressurser og unødvendig omarbeid. Disse problemene skaper frustrasjon og lavere produktivitet. På den annen side forenkler de riktige verktøyene prosessen, forbedrer nøyaktigheten og sparer verdifull tid.

jeg brukte løpet 180 timer nøye undersøke og sammenligne 40+ verktøy for testdatagenerator før jeg laget denne veiledningen. Av disse valgte jeg ut de 12 mest effektive alternativene. Denne anmeldelsen er støttet av min førstehåndserfaring med disse verktøyene. I denne artikkelen deler jeg hovedfunksjonene, fordeler og ulemper og priser for å gi deg fullstendig klarhet. Sørg for at du leser til slutten for å velge det som passer best for dine behov. Les mer ...

BEST-testdata Generator Verktøy: Toppvalg!

| Testdata Generator Tool | Viktige funksjoner | Gratis prøveperiode / garanti | link |

|---|---|---|---|

| EMS Data Generator | Støtte for JSON-typer, DB-migrering, datakoding | 30-dagers gratis prøveperiode | Finn ut mer |

| Informatica TDM | Automatisert maskering av sensitive data, forhåndsbygde akseleratorer, samsvarsrapportering | Gratis demo tilgjengelig | Finn ut mer |

| Dobbelt | Sterkt tilsyn, integrering av database-API, datastyring | Be om demonstrasjon | Finn ut mer |

| Broadcom EDMS | Enhetlig PII-skanning, skalerbar maskering over store datasett, støtte for NoSQL-databaser | Be om demonstrasjon | Finn ut mer |

| SAP Test Data Migration Server | Snapshot-funksjon, datavalgsparallellisering, aktiv skalloppretting | Be om demonstrasjon | Finn ut mer |

1) EMS Data Generator

EMS Data Generator er et intuitivt verktøy skreddersydd for å generere syntetiske data på tvers av flere databasetabeller samtidig. Jeg satte pris på hvor enkelt det lot meg konfigurere randomiserte datasett og forhåndsvise resultater før bruk. De skjemabaserte genereringsmulighetene og den brede støtten for datatyper som ENUM, SET og JSON gjøre den fleksibel nok til å håndtere ulike testbehov.

I ett tilfelle utnyttet jeg EMS Data Generator for å sette opp testdatabaser under et migreringsprosjekt, og det effektiviserte prosessen uten at det gikk på bekostning av datanøyaktigheten. Verktøyets evne til å generere parameteriserte datasett og lagre dem som SQL-skript sikrer problemfri testing, noe som gjør det til et pålitelig valg for databaseadministratorer og QA-ingeniører som håndterer både små og store arbeidsmengder.

Egenskaper:

- Datakoding: Denne funksjonen lar deg håndtere ulike kodingsalternativer smidig, noe som er avgjørende når du jobber på tvers av flere miljøer. Den støtter Unicode-filer, slik at selv flerspråklige testdata dekkes uten problemer. Jeg brukte den til å administrere skript sømløst, og resultatene var alltid konsistente.

- Programinstallasjon: Den pakker genererte testdata praktisk inn i installasjonspakker, noe som sikrer at alt forblir samlet for umiddelbar bruk. Jeg syntes dette var ekstremt nyttig når jeg raskt skulle sette opp miljøer på nye systemer. Mens jeg testet denne funksjonen, la jeg merke til hvor mye den reduserte repeterende oppsettoppgaver.

- Databasemigrering: Du kan enkelt migrere mellom databasesystemer uten å bekymre deg for å miste kritisk informasjon. Det har hjulpet meg med å overføre store datasett fra MySQL til PostgreSQL problemfritt. Jeg anbefaler å sjekke migreringsloggene grundig for å bekrefte skjemakompatibilitet før distribusjon til produksjon.

- Støtte for JSON-datatyper: Den støtter JSON-datatyper for populære databaser som Oracle 21c, MySQL 8, Ildfugl 4 og PostgreSQL 16Dette gjør den fremtidssikker for moderne applikasjoner som er avhengige av dokumentlagring. I ett tilfelle brukte jeg den til å validere API-testscenarier ved å generere JSON direkte i databasen.

- Støtte for komplekse datatyper: Utover standardfelt håndterer verktøyet SET-, ENUM- og GEOMETRY-typene, noe som er et stort pluss for avanserte databasemodeller. Jeg har testet dette mens jeg modellerte lokasjonsbaserte datasett, og det fungerte perfekt uten at det var nødvendig med manuelle justeringer.

- Forhåndsvis og rediger genererte data: Denne funksjonen lar deg forhåndsvise og endre genererte data før du ferdigstiller dem, noe som sparer tid under feilsøking. Verktøyet lar deg lagre redigeringer direkte i SQL-skript, noe som gjør integrering i CI/CD-pipelines enklere. Jeg foreslår å bruke versjonskontroll for disse skriptene for å opprettholde reproduserbarhet på tvers av testkjøringer.

Pros

Ulemper

Priser:

Her er noen av startplanene som tilbys av EMS Data Generator

| EMS Data Generator for InterBase/Firebird (Business) + 1 års vedlikehold | EMS Data Generator forum Oracle (Bedrift) + 1 års vedlikehold | EMS Data Generator for SQL Server (Business) + 1 års vedlikehold |

|---|---|---|

| $110 | $110 | $110 |

Gratis prøveperiode: 30-dagers prøveversjon

2) Informatica Test Data Management

Informatica Test Data Management er en av de mest avanserte løsningene jeg har jobbet med for oppretting av syntetiske data og robust beskyttelse. Jeg ble imponert over hvor sømløst den automatiserte dataidentifikasjon og maskering på tvers av komplekse databaser, noe som sparte meg for tidkrevende manuelle kontroller. Muligheten til å maskere sensitive data samtidig som jeg opprettholdt skjemaintegriteten ga meg trygghet i å oppfylle samsvarskrav uten å bremse prosjekter.

Jeg syntes det var spesielt nyttig når jeg forberedte parameteriserte datasett for automatiserte testtilfeller, ettersom det lot meg lage delsett uten å overbelaste infrastrukturen. Denne tilnærmingen forbedret ikke bare ytelsen, men gjorde også testsykluser raskere og mer kostnadseffektive. Informatica TDM skinner virkelig når det gjelder håndtering av sensitive produksjonsdata som trenger maskering og gjenbruk for trygge testmiljøer.

Egenskaper:

- Automatisert dataidentifikasjon: Denne funksjonen identifiserer raskt sensitive data på tvers av flere databaser, noe som gjør det mye enklere å administrere samsvar og sikkerhet. Den bruker kontinuerlig maskering, noe som sikrer at ingen rådata blir eksponert under testing. Jeg syntes dette var spesielt nyttig når jeg jobbet med helsedatasett der HIPAA-samsvar var et must.

- Datadelsett: Du kan opprette mindre datasett med høy verdi som fremskynder testkjøringen samtidig som infrastrukturkostnadene reduseres. Dette er ekstremt nyttig for regresjonstesting, der gjentatte kjøringer trenger rask tilgang til konsistente datasett. Mens jeg brukte dette, la jeg merke til at testsyklusene ble mer effektive, med redusert systembelastning.

- Forhåndsbygde akseleratorer: Den leveres med innebygde maskeringsakseleratorer for vanlige dataelementer, noe som hjelper deg med å overholde regelverket uten å måtte oppfinne hjulet på nytt. Disse akseleratorene sparer tid og forbedrer påliteligheten når du håndterer konfidensielle felt som personnummer eller kortopplysninger. Jeg foreslår at du utforsker tilpasningsmuligheter for bransjespesifikke dataformater for å maksimere verdien.

- Overvåking og rapportering: Denne funksjonen gir detaljert overvåking og revisjonsklar rapportering for risiko og samsvar. Det bringer styringsteam direkte inn i loopen, noe som bidrar til å samkjøre kvalitetssikring med bedriftens datapolicyer. Jeg vil anbefale å planlegge automatiserte rapporter i CI/CD-pipelines, slik at samsvarskontroller blir en del av den daglige testingen i stedet for et siste-liten-kaos.

- Enhetlig datastyring: Det sikrer at konsistente retningslinjer anvendes på tvers av bedriften, noe som reduserer samsvarsrisikoer. Jeg har sett hvordan dette hjelper store organisasjoner med å unngå siloer samtidig som de opprettholder nøyaktige og pålitelige data.

- Automatisert dataintelligens: Den utnytter AI-drevet automatisering for å gi kontinuerlig innsikt i databruk, -avstamning og -kvalitet. Dette forbedrer ikke bare åpenheten, men akselererer også beslutningstaking. Mens jeg testet dette, la jeg merke til at det reduserte den manuelle innsatsen med å spore dataopprinnelse og -transformasjoner betydelig.

Pros

Ulemper

Priser:

- Pris: Du kan be om salg for et pristilbud

- Gratis prøveperiode: Du får en gratis demo

3) Dobbel

Doble skiller seg ut som et praktisk valg for organisasjoner som trenger strukturert håndtering av testdata. Da jeg brukte det til å organisere store sett med randomiserte datasett på tvers av avdelinger, la jeg merke til hvor mye smidigere testingen ble. Verktøyet gjør det enkelt å rydde, konvertere og kategorisere data, noe som sikrer nøyaktighet ved håndtering av ulike testplaner. Evnen til å integrere med API-er og forretningsintelligensverktøy gir reell verdi i daglige testarbeidsflyter.

Jeg satte pris på hvordan den effektiviserte testing på feltnivå ved å konsolidere resultater i logiske mapper, noe som reduserte forvirringen rundt spredte datasett. Etter å ha erfart påliteligheten i håndtering av maskerte produksjonsdata, vil jeg si at Doble er spesielt nyttig for team som prioriterer datakonsistens og styring, samtidig som de reduserer kostnadene ved manuell organisering.

Egenskaper:

- Administrere data: Denne funksjonen lar deg administrere ulike testdatatyper, som SFRA og DTA, med konsistens. Den bidrar til å opprettholde produktiviteten på tvers av prosjekter og støtter skjemabasert generering der det er nødvendig. Jeg har personlig brukt den til å lage organiserte, gjenbrukbare maler som reduserer manuell innsats.

- Sterkt tilsyn: Det gir tilsyn for å håndheve robuste standarder for datastyring. Dette er ikke bare reduserer overflødige prosesser men forbedrer også samsvarsvennlige arbeidsflyter. Mens jeg testet den, la jeg merke til hvor godt den integreres i DevOps-pipelines i bedriftsklassen, noe som gjør det enklere å oppdage ineffektivitet før den eskalerer.

- Datastyring: Denne funksjonen sikrer logisk lagring og sikkerhetskopiering, slik at testdataene holdes strukturerte og tilgjengelige. Den bygger pålitelighet inn i ytelses- og regresjonstestingscenarier. Jeg anbefaler å bruke dette når du jobber med maskerte produksjonsdata, da det effektiviserer revisjon samtidig som sikkerheten opprettholdes.

- Database API: Database-API-et leverer et fleksibelt tjenestelag for henting av testdata og analyseresultater som FRANK™-poengsummer. Det støtter integrasjon med BI-verktøy, noe som muliggjør automatiseringsklare rapporteringsrørledninger. Jeg foreslår å bruke dette for CI/CD-støtte der datainnsikt må være kontinuerlig tilgjengelig.

- Standardiserte prosesser: Denne funksjonen fokuserer på å eliminere manuelle og overflødige prosesser ved å standardisere hvordan data samles inn og lagres. Den muliggjør kompatibilitet på tvers av plattformer og reduserer risikoen for fragmenterte arbeidsflyter. Jeg har sett den spare timer under storskala programvarevalideringsarbeid der dekning av kantsaker var kritisk.

- Kunnskapsressurser og opplæring: Doble gir tilgang til strukturerte veiledninger og opplæring som hjelper team med å ta i bruk beste praksis. Dette sikrer konsistens i hvordan testdata håndteres på tvers av avdelinger. I tillegg la jeg merke til at det skreddersydde læringsmateriellet gjør adopsjonen raskere, selv i smidige miljøer.

Pros

Ulemper

Priser:

- Pris: Du kan be om salg for et pristilbud

- Gratis prøveperiode: Du ber om en demo

4) Broadcom EDMS

Broadcom EDMS er en kraftig plattform for generering av testdata som jeg syntes var spesielt effektiv for å bygge skjemabaserte og regeldrevne datasett. Jeg likte hvordan den tillot meg å trekke ut og gjenbruke forretningsdata samtidig som jeg brukte maskeringsregler som beskyttet sensitiv informasjon. Delfunksjonene – som sletting, innsetting og avkorting – ga presis kontroll over opprettelse av datasett, noe som gjorde testing mer tilpasningsdyktig.

I ett scenario brukte jeg det til å generere randomiserte datasett for API-testing, og sørget for at kanttilfeller ble dekket uten å eksponere produksjonsdata. Den omfattende deteksjonen av konfidensielle kilder, kombinert med planleggingsalternativer, gjorde det enklere å opprettholde samsvar samtidig som det fremskyndet automatiserte testtilfeller. Broadcom EDMS utmerker seg i å balansere avansert sikkerhet med fleksibilitet i dataforberedelse.

Egenskaper:

- Dataassistent Plus: Denne funksjonen lager realistiske, skjemabaserte syntetiske data ved hjelp av regeldrevne algoritmer som etterligner produksjonslogikk uten å eksponere sensitiv informasjon. Jeg har sett den fremskynde testtilfelleberedskapen ved å la testere simulere sjeldne feiltilstander uten å vente på produksjonsdata.

- Enhetlig PII-skanning, maskering og revisjonsarbeidsflyt: Den lokaliserer, klassifiserer og håndterer personlig identifiserende informasjon på en sikker måte gjennom en sømløs arbeidsflyt – skanning, maskering og deretter samsvarskontroll. Den sikrer at personvernlover som GDPR/HIPAA overholdes, noe som gjør dataene kompatible og sikre før testbruk.

- Skalerbar maskering over store datasett: Den støtter maskering av store datamengder med minimal konfigurasjonsoverhead. Den kan skalere maskeringsjobber horisontalt (f.eks. på Kubernetes-klynger), automatisk allokere ressurser avhengig av volum, og deretter rive dem ned etter bruk.

- Støtte for NoSQL-databaser: Du kan nå bruke praksiser for håndtering av testdata (maskering, syntetisk generering osv.) til NoSQL plattformer som MongoDB, Cassandra, BigQueryDette utvider anvendeligheten utover relasjonelle systemer. Jeg har brukt dette i miljøer der blandede relasjons- og dokumentdatabaser forårsaket forsinkelser. Dermed har jeg ett verktøy som dekker både forbedret reproduserbarhet og enkel integrering.

- Selvbetjeningsportal og datareservasjon: Testere kan bruke en portal til å be om og reservere spesifikke datasett (f.eks. finne og reservere operasjoner) uten å kopiere hele produksjonssett. Dette bidrar til å redusere ledetider og unngår unødvendig dataduplisering.

- CI/CD og DevOps-pipelineintegrasjon: Verktøyet støtter innebygging av testdataklargjøring, generering av syntetiske data, maskering og datadelsettoperasjoner i CI/CD-pipelines. Det flytter TDM «til venstre» – dvs. til design- og byggefaser – slik at testsyklusene blir kortere og testing blir mindre av en flaskehals.

Pros

Ulemper

Priser:

- Pris: Du kan kontakte salgsavdelingen for et pristilbud

- Gratis prøveperiode: Du ber om en demo

5) SAP Test Data Migration Server

SAP Test Data Migration Server er en pålitelig løsning for å generere og migrere realistiske SAP testdata på tvers av systemer. Jeg syntes den var spesielt effektiv når jeg håndterte storskala testscenarioer fordi den strømlinjeformet arbeidsflytene mine samtidig som den sikret samsvar med standarder for personvern. Den innebygde krypteringen av sensitiv informasjon ga meg trygghet om at testdataene speilet produksjonsdataene på en sikker måte.

I praksis brukte jeg det til å replikere komplekse datasett for treningsmiljøer, noe som reduserte oppsetttid og infrastrukturkostnader drastisk. Funksjoner som parallellisering av datautvalg og aktiv skalloppretting gjorde prosessen svært effektiv, slik at jeg kunne gjennomføre automatiserte testtilfeller med maskerte produksjonsdata og simulere ende-til-ende-testing på rekordtid.

Egenskaper:

- Snapshot-funksjon: Denne funksjonen lar deg ta et logisk øyeblikksbilde av datavolumer, noe som gir deg en pålitelig oversikt over en spesifikk lagringstilstand. Den hjelper med å reprodusere konsistente miljøer for testing og trening uten å duplisere hele datasett. Jeg har brukt den til å effektivisere regresjonstesting, og den sparer virkelig tid.

- Parallellisering av datautvalg: Det lar deg kjøre flere batchjobber samtidig når du velger data. Dette akselererer migreringsprosessen og sikrer at storskala testdataoppretting er mer effektiv. Jeg vil anbefale å bruke mindre jobboppdelinger når du håndterer komplekse SAP landskap for å unngå flaskehalser.

- Opprette brukerroller: Du kan definere rollebasert tilgang på tvers av hele datamigreringsprosesstreet. Det sikrer at testere og utviklere bare ser dataene de trenger, noe som forbedrer både sikkerhet og samsvar. Mens jeg brukte dette, la jeg merke til hvordan det forenklet revisjon under testsykluser.

- Oppretting av aktivt skall: Denne funksjonaliteten gjør det mulig å kopiere applikasjonsdata fra én SAP system til et annet ved hjelp av kjernesystemets kopieringsprosess. Det er ekstremt nyttig for å raskt sette opp opplæringssystemer. Jeg testet det i et prosjekt der en klient trengte flere sandkassemiljøer, og det reduserte klargjøringstiden drastisk.

- Datakryptering: Verktøyet inkluderer kraftige alternativer for datakryptering for å anonymisere sensitive forretningsdata under overføringer. Det hjelper organisasjoner holde seg i samsvar med GDPR og andre personvernforskrifterDu vil legge merke til hvor fleksible scrambling-reglene er, spesielt når de skreddersys for økonomiske og HR-data.

- Datamigrering på tvers av systemer: Den støtter overføring av testdata på tvers av ikke-tilkoblede datasentre, noe som gjør den svært verdifull for globale bedrifter. Denne funksjonen er spesielt nyttig for team som jobber med kontinuerlig integrasjon og DevOps-pipelines der miljøer er distribuert over hele verden. Jeg foreslår å planlegge migreringer i vinduer med lav trafikk for å sikre optimal ytelse.

Pros

Ulemper

Priser:

- Pris: Du kan kontakte salgsavdelingen for et pristilbud

- Gratis prøveperiode: Du ber om en demo

6) Upscene – Advanced Data Generator

Upscene – Advanced Data Generator utmerker seg ved å lage realistiske, skjemabaserte testdatasett for databaser. Jeg var spesielt imponert over hvor intuitivt grensesnittet føltes når jeg designet datamodeller og håndhevet begrensninger på tvers av relaterte tabeller. I løpet av minutter kunne jeg produsere randomiserte datasett som føltes autentiske nok til å validere spørreytelsen og stressteste databasen min.

Da jeg jobbet med et prosjekt som krevde stresstesting før utrulling, hjalp Upscene meg generere parameteriserte datasett skreddersydd til spesifikke scenarier uten manuell innsats. Støtten for flere datatyper og makroer sørget for at jeg hadde full fleksibilitet i å bygge pipelines for syntetisk dataoppretting, noe som til slutt forbedret testdekningen og automatiserte valideringsprosesser.

Egenskaper:

- HiDPI-bevisst grensesnitt: Denne oppdateringen forbedrer tilgjengeligheten med store verktøylinjeikoner, skalerte fonter og skarpere grafikk, noe som gjør det mye enklere å bruke på moderne skjermer med høy oppløsning. Du vil legge merke til at selv lange testøkter føles jevnere på grunn av redusert belastning når du navigerer i datasett.

- Utvidede databiblioteker: Den inkluderer nå franske, tyske og italienske navn, gater og bydata, noe som utvider muligheten din til å simulere globale brukerscenarier. Dette er spesielt verdifullt hvis programvaren din trenger samsvarsvennlige datasett for flerspråklige markeder. Jeg brukte disse bibliotekene til å validere skjemavalideringer i en tverrregional HR-app, og det føltes uanstrengt.

- Avansert datagenereringslogikk: Du kan nå generere verdier på tvers av flere passeringer, bruke makroer for å lage komplekse resultater, og bygge numeriske data som refererer til tidligere oppføringer. Mens jeg testet denne funksjonen, syntes jeg den var utmerket for å simulere statistiske datasett i ytelsestestscenarier, spesielt når man bygger trendbaserte simuleringer.

- Automatiske sikkerhetskopier: Alle prosjekter drar nå nytte av automatisk sikkerhetskopieringsfunksjonalitet, som sikrer at du aldri mister konfigurasjoner eller testdataskript. Det er et lite tillegg, men jeg gjenopprettet en gang et overskrevet skjemaoppsett på få minutter takket være denne sikkerhetstiltakene – det sparte meg for timer med omarbeid.

- Generer fornuftige data: Denne funksjonen hjelper deg med å lage realistiske, presentasjonsklare testdata som unngår tilfeldig vrøvl som ofte brukes under testing. Den inkluderer omfattende databiblioteker og flerspråklig støtte, slik at du kan generere navn, adresser og andre felt på forskjellige språk. Jeg syntes dette var spesielt nyttig når jeg forberedte demomiljøer for kunder som trengte lokaliserte datasett.

- Komplekse flertabelldata: Denne funksjonen lar deg generere testdata på tvers av flere sammenkoblede tabeller, noe som sparer mye tid når du validerer relasjonsdatabaser. Den sikrer konsistens i koblede poster, noe som gjør regresjonstesting og skjemavalidering mer pålitelig. Jeg så også hvor sømløst den bevarte fremmednøkkelrelasjoner, og eliminerte risikoen for poster som ikke samsvarer.

Pros

Ulemper

Priser:

Her er noen av planene som tilbys av Upscene:

| Avanserte data Generator for tilgang | Avanserte data Generator forum MySQL | Avanserte data Generator for Ildfuglen |

|---|---|---|

| €119 | €119 | €119 |

Gratis prøveperiode: Du kan laste ned en gratisversjon

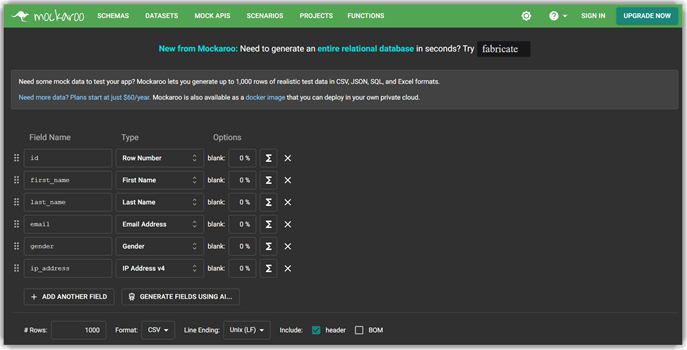

7) Mockaroo

Mockaroo er et kraftig og fleksibelt verktøy for generering av testdata som raskt ble en av favorittene mine. Jeg satte pris på hvor enkelt det var å produsere tusenvis av rader i formater som JSON, CSV, Excel eller SQL, perfekt tilpasset mine behov for generering av testdata. Det brede settet med databiblioteker lar meg konfigurere skjemabasert generering med presis kontroll over felt som adresser, telefonnumre og geokoordinater.

I ett tilfelle brukte jeg den til å sette opp en database med randomiserte datasett for API-testing, noe som hjalp med å avdekke kanttilfeller jeg ikke hadde forutsett. Ved å la meg designe simulerte API-er og definere tilpassede svar, gjorde Mockaroo det sømløst å simulere virkelige scenarier samtidig som jeg beholdt kontrollen over variasjon og feilforhold.

Egenskaper:

- Hån mot biblioteker: Den leveres med omfattende biblioteker som støtter flere programmeringsspråk og plattformer. Dette gjør integrering i CI/CD-pipelines eller automatiseringsrammeverk nesten uanstrengt. Jeg foreslår å utforske de API-drevne alternativene her fordi de lar deg bygge parameteriserte datasett som kan gjenbrukes i forskjellige regresjonstestsykluser. Denne fleksibiliteten kan spare deg for timer med repeterende oppsett.

- Tilfeldige testdata: Du kan generere tilfeldige datasett umiddelbart i CSV-, SQL-, JSON- eller Excel-formaterJeg brukte dette under et ytelsestestprosjekt, og det reduserte den manuelle innsatsen betydelig samtidig som dataene ble holdt mangfoldige. Mens jeg brukte denne funksjonen, la jeg merke til at justering av randomiseringsinnstillinger for kanttilfeller – som uvanlig lange strenger – bidrar til å avdekke skjulte feil tidlig.

- Tilpasset skjemadesign: Denne funksjonen lar deg opprette skjemabaserte genereringsregler slik at dataene speiler dine faktiske produksjonsstrukturer. Det er spesielt nyttig for databasesåing i agile sprinter. Jeg husker at jeg bygde et skjema for et helseprosjekt, og det gjorde valideringer mer kompatible med sensitive datamodeller uten å eksponere ekte poster.

- API-simulering: Du kan raskt designe simulerte API-er, definere URL-er, svar og feiltilstander. Dette er en livredder for team som venter på backend-tjenester, siden det sørger for at frontend-utviklingen går knirkefritt. Jeg vil anbefale å versjonere simulerte endepunkter logisk – spesielt når flere utviklere tester samtidig – for å unngå konflikter og forvirring.

- Skalerbarhet og volum: Mockaroo støtter generering store mengder data for storskala testingJeg brukte den én gang til å simulere over en million rader for en finansiell regresjonstest, og den opprettholdt både hastighet og pålitelighet. Den er klar for automatisering, noe som betyr at du kan legge den inn i kontinuerlige integrasjonsflyter og skalere med utviklende prosjektkrav.

- Alternativer for dataeksport: Verktøyet tillater eksport i flere formater, noe som sikrer kompatibilitet på tvers av systemer og testrammeverk. Du vil legge merke til hvor praktisk dette blir når du bytter mellom SQL-baserte tester og Excel-drevne testtilfeller. Verktøyet lar deg håndtere scenarier på tvers av plattformer sømløst, noe som er spesielt verdifullt i QA-miljøer på bedriftsnivå.

Pros

Ulemper

Priser:

Her er årsplanene til Mockaroo:

| Sølv | Gull | Enterprise |

|---|---|---|

| $60 | $500 | $7500 |

Gratis prøveperiode: Du får en gratis plan med 1000 rader per fil

Link: https://mockaroo.com/

8) GenerateData

GenerateData er en åpen kildekode-testdatagenerator bygget med PHP, MySQLog JavaSkript som gjør det enkelt å produsere store mengder realistiske, skjemabaserte datasett for testing. Jeg syntes det var spesielt nyttig da jeg trengte rask syntetisk dataoppretting på tvers av flere formater, fra CSV til SQL, uten at det gikk på bekostning av struktur eller integritet. Utvidbarheten gjennom tilpassede datatyper lar utviklere skreddersy datasett nøyaktig til prosjektets krav.

Da jeg brukte den til å opprette en database for automatiserte testtilfeller, sparte fleksibiliteten til å definere regeldrevet generering og legge til sammenkoblede plugins for postnumre og regioner timer med manuell oppsett. Med det enkle grensesnittet og det GNU-lisensierte rammeverket, GenerateData viste seg å være en pålitelig følgesvenn for randomiserte datasett og parameterisert datagenerering under iterative testsykluser.

Egenskaper:

- Sammenkoblede data: Den lar deg generere stedsspesifikke verdier som byer, regioner og postnumre som er logisk knyttet sammen. Denne sammenkoblede tilnærmingen sikrer repeterbarhet og realistiske sammenhenger på tvers av datasett. Jeg foreslår å bruke dette når du tester samsvarsvennlige dataarbeidsflyter, siden det gjenspeiler produksjonslignende forhold veldig nøye.

- GNU-lisensfleksibilitet: Å være fullt ut GNU-lisensiert, dette verktøyet gir frihet for tilpasning og distribusjon uten begrensninger. Det er spesielt nyttig for team som ønsker en skalerbar løsning i bedriftsklassen uten leverandørbinding. Jeg har integrert det i en CI/CD-pipeline der automatiseringsklare verktøy var avgjørende, og det økte produktiviteten betydelig.

- Generering av datavolum: Denne funksjonen lar deg produsere store datasett på tvers av flere formater, som CSV, JSON eller SQLDu kan enkelt sette opp databaser for regresjonstesting eller simulere API-testing i stor skala. Ved å bruke det så jeg at generering av store datasett i grupper kan redusere minneforbruket og forbedre effektiviteten.

- Plugin-støtte for utvidelse: GenerateData støtter tillegg av plugins, slik at du kan utvide funksjonaliteten med nye landsdatasett eller regeldrevne genereringsalternativer. Det forbedrer fleksibiliteten og fremtidssikringen for unike brukstilfeller. Et praktisk scenario er å bygge testmiljøer som krever tilpasset dataanonymisering for globale team.

- Eksport av flere formater: Du kan umiddelbart generere testdata i mer enn ti utdataformater, inkludert JSON, XML, SQL, CSV og til og med kodebiter i Python, C# eller Ruby. Dette sikrer sømløs integrering i ulike DevOps-pipeliner. Jeg anbefaler å eksportere små grupper først når du konfigurerer, slik at skjemavalideringen går knirkefritt.

- Lagring og gjenbruk av datasett: Det finnes også et alternativ som lar deg lagre datasettene dine under en brukerkonto, noe som gjør det enkelt å gjenbruke konfigurasjoner på tvers av flere prosjekter. Dette reduserer manuell innsats og sikrer reproduserbarhet. Jeg har brukt dette i kontinuerlige integrasjonsmiljøer for å holde testkjøringer konsistente over tid.

Pros

Ulemper

Priser:

Det er et åpen kildekode-prosjekt

9) Delphix

Delphix er en kraftig plattform for generering og administrasjon av testdata, som tilbyr maskerte produksjonsdata og sikre syntetiske datasett for å akselerere utviklingen. Det som skilte seg ut for meg var evnen til å virtualisere datamiljøer – noe som gjør det mulig å bokmerke, tilbakestille og dele versjoner uten avbrudd. Jeg syntes dette var spesielt effektivt når jeg jobbet med parallelle automatiserte testtilfeller der samsvar med GDPR og CCPA var ikke til forhandlingspunkt.

I ett scenario brukte jeg Delphix å klargjøre datadelsett på forespørsel, noe som sikrer raskere CI/CD-integrasjon samtidig som sensitiv informasjon bevares gjennom forhåndsdefinerte maskeringsalgoritmer. Den utvidbare API-støtten og den sømløse synkroniseringen med ulike testmiljøer gjorde den til en hjørnestein for pålitelig databasesåing, parameteriserte datasett og kontinuerlige leveringsrørledninger.

Egenskaper:

- Feil med deling av bokmerker: Denne funksjonen gjør det enkelt å dele øyeblikksbilder av problematiske miljøer med utviklere, noe som reduserer feilsøkingstiden drastisk. Jeg har brukt den under regresjonstesting, og den hjalp teamet mitt med å raskt finne tilbakevendende problemer. Jeg foreslår at bokmerker navngis logisk, slik at alle kan spore feil uten problemer.

- Dataoverholdelse: Det sikrer at sensitiv informasjon anonymiseres konsekvent på tvers av millioner av rader, i samsvar med GDPR, CCPA og andre forskrifter. Mens jeg brukte det i et økonomisk prosjekt, la jeg merke til hvor sømløs maskeringen føltes uten å bryte skjemaforhold. Du vil legge merke til at samsvarsrapportering blir smidigere når den integreres i revisjonsarbeidsflyter.

- Utvidbar og åpen: Delphix tilbyr fleksible alternativer med brukergrensesnitt, CLI og API-er, slik at team kan administrere dataoperasjoner på tvers av forskjellige oppsett. Jeg fant ut at det var integrasjon med CI/CD-rørledninger spesielt kraftig for kontinuerlig testing. Denne funksjonen støtter også tilkoblinger med flere overvåkings- og konfigurasjonsadministrasjonsverktøy, noe som øker smidigheten i DevOps-pipelines.

- Versjonskontroll og tilbakestilling: Jeg likte hvordan Delphix lar meg bokmerke og tilbakestille datasett til en hvilken som helst tidligere tilstand, noe som forbedrer repeterbarheten under ytelsestesting. Jeg brukte det da jeg rullet tilbake til en ren grunnlinje før jeg kjørte dekningstester for kanttilfeller. Det sparer timer med omarbeiding og sikrer konsistente testscenarier.

- Data Synchronisering: Du kan holde testmiljøer kontinuerlig justert med produksjonslignende datasett uten avbrudd. Under et helseprosjekt så jeg hvordan synkroniserte data reduserte avvik mellom simulerte tjenester og systemet som ble testet. Denne konsistensen forbedrer reproduserbarheten og bygger tillit til testresultatene.

- Tilpasset og forhåndsdefinert maskering Algorithms: Den leveres med robuste maskeringsteknikker for å beskytte sensitive felt samtidig som den bevarer brukervennligheten. Jeg vil anbefale å eksperimentere med regeldrevet maskering i sandkassemiljøer før du bruker den på produksjonslignende data, da dette bidrar til å identifisere eventuelle avvik tidlig. Balansen mellom sikkerhet og funksjonalitet er en av dens sterkeste egenskaper.

Pros

Ulemper

Priser:

- Pris: Du kan kontakte salg for et tilbud.

- Gratis prøveperiode: Brukere kan be om en demo

10) Original Software

Original Software bringer en omfattende tilnærming til generering av testdata ved å støtte både testing på databasenivå og brukergrensesnittnivåJeg satte pris på dens evne til å opprettholde referensiell integritet samtidig som den opprettet delsett av syntetiske testdata, noe som sikret at randomiserte datasett speilet virkelige forhold. Verktøyets evne til å integreres med andre testrammeverk forbedret den generelle kvaliteten og reduserte redundans i arbeidsflytene mine.

Mens jeg håndterte et scenario som involverte API-testing, stolte jeg på den detaljerte sporingen av innsettinger, oppdateringer og slettinger for å validere mellomliggende tilstander under batchbehandling. Denne regeldrevne genereringen, kombinert med sterke obfuskeringsmetoder for sensitive data, ga meg trygghet for at både sikkerhet og effektivitet ble opprettholdt. Det er et sterkt valg for team som verdsetter fleksibel syntetisk dataoppretting med automatisert testcasevalidering.

Egenskaper:

- Vertikal datamaskering: Denne funksjonen lar deg maskere sensitive data i produksjons- eller testdatasett, slik at du bevarer konfidensialiteten samtidig som du har realistiske verdier. Den støtter selektiv maskering etter kolonne eller felt («vertikal»), slik at bare de virkelig sensitive delene skjules. Jeg har brukt lignende verktøy og funnet ut at det å ha tilpassbare maskeringsregler (f.eks. bevare format, lengde, type) sparer omarbeid.

- Gjenoppretting av kontrollpunkt: Dette verktøyet lar deg ta øyeblikksbilder av databasen din og rulle tilbake til dem når det er nødvendig, noe som gir presis kontroll under testing. Det reduserer avhengigheten av databasedatabaser og gjør regresjonssykluser reproduserbare. Jeg gjenopprettet en gang hele skjemaer på få minutter etter mislykkede migreringstester, noe som sparte betydelig nedetid.

- Datavalidering Operators: Denne funksjonen bringer over 20 operatører for kontroller som tilstedeværelse, deteksjon av endrede verdier, forventede vs. faktiske verdier og validering på tvers av filer. Det gir fleksibilitet til å teste korrekthet på tvers av komplekse scenarier. Mens jeg testet det, la jeg merke til at kombinasjonen av SUM- og EXISTS-valideringer sikrer at relasjonsintegriteten bevares under oppdateringer.

- Database- og applikasjonsvalidering under tester: Med denne funksjonen kan du validere ikke bare testdata, men også databaseendringer utløst av applikasjonslogikk som utløsere, oppdateringer og slettinger. Den er svært effektiv for regresjonstesting, og sikrer at nedstrømsprosesser forblir kompatible og pålitelige.

- Krav til sporbarhet og dekning: Denne funksjonen kobler testtilfeller direkte til krav og kartlegger testresultater tilbake til dem, noe som fremhever hull i dekningen. Den holder oversikten transparent på tvers av team og er spesielt verdifull under revisjoner.

- Manuell og automatisert testutførelse med CI/CD-integrasjon: Denne funksjonen gjør det mulig å utføre tester manuelt eller automatisk, noe som gjør den tilpasningsdyktig til utforskende testing eller regresjonstesting. Den integreres sømløst med CI/CD-pipelines, og logger utførelsesresultater og statuser.

Pros

Ulemper

Priser:

- Pris: Du kan kontakte salg for et tilbud.

- Gratis prøveperiode: Brukere kan be om en demo

Sammenligningstabell

Her er en rask sammenligningstabell for verktøyene ovenfor:

| Trekk | EMS Data Generator | Informatica TDM | Dobbelt | Broadcom |

|---|---|---|---|---|

| Syntetisk datagenerering | ✔️ | ✔️ | ❌ | ✔️ |

| Datamaskering / Anonymisering | begrenset | ✔️ | ❌ | ✔️ |

| Datainndeling / Utvalg | ✔️ | ✔️ | ❌ | ✔️ |

| Referensielt Integrity Bevaring | ✔️ | ✔️ | ✔️ | ✔️ |

| CI/CD / automatiseringsintegrasjon | begrenset | ✔️ | ✔️ | ✔️ |

| Testdatabibliotek / Versjonskontroll | begrenset | ✔️ | ✔️ | begrenset |

| Virtualisering / Tidsreiser | ✔️ | begrenset | ❌ | begrenset |

| Selvbetjening / Brukervennlighet | ✔️ | ✔️ | ✔️ | begrenset |

Hva er testdata Generator?

A testdata Generator er et verktøy eller programvare som automatisk lager store sett med data for testformål. Disse dataene brukes vanligvis til å teste programvareapplikasjoner, databaser eller systemer for å sikre at de kan håndtere forskjellige scenarier, for eksempel høyt volum, ytelse eller stressforhold. Testdata kan være syntetiske eller basert på virkelige data, avhengig av testbehovene. Det hjelper til med å simulere ekte brukerinteraksjoner og kantsaker, noe som gjør testprosessen mer effektiv, grundig og mindre tidkrevende.

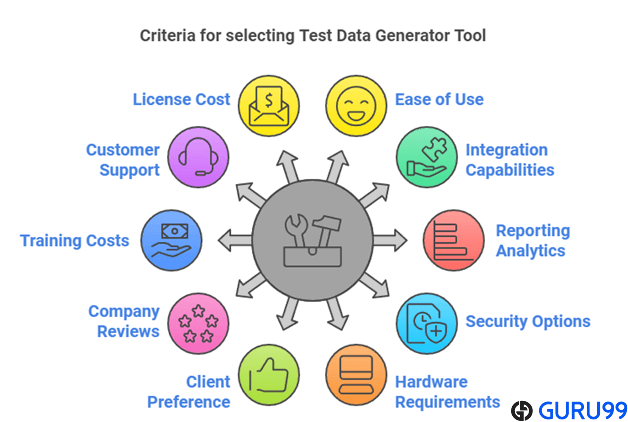

Hvordan valgte vi de beste testdataene Generator Verktøy?

Vi er en pålitelig kilde fordi vi har investert over 180 timer i research og sammenligning av over 40 verktøy for testdatageneratorer. Fra denne omfattende evalueringen har vi nøye valgt ut de 12 mest effektive alternativene. Gjennomgangen vår er basert på direkte, praktisk erfaring, noe som sikrer at leserne får pålitelig, objektiv og praktisk innsikt for å ta informerte valg.

- Brukervennlighet: Teamet vårt prioriterte verktøy med intuitive grensesnitt, slik at testere og utviklere kunne generere data raskt uten en bratt læringskurve.

- Ytelseshastighet: Vi fokuserte på løsninger som leverer rask datagenerering i stor skala, slik at bedrifter kan teste store applikasjoner effektivt med minimal nedetid.

- Datamangfold: Våre anmeldere valgte verktøy som støtter et bredt utvalg av datatyper og formater for å simulere realistiske testscenarioer på tvers av flere miljøer.

- Integrasjonsevne: Vi evaluerte kompatibilitet med CI/CD-pipelines, databaser og automatiseringsrammeverk, noe som sikret smidigere arbeidsflyter for utviklings- og testteam.

- Tilpasningsalternativer: Våre eksperter la vekt på verktøy som tilbyr fleksible regler og konfigurasjoner, slik at team kan skreddersy testdata for å møte unike forretningskrav.

- Sikkerhetstiltak: Vi vurderte verktøy med sterk samsvarsstøtte, maskerings- og anonymiseringsfunksjoner for å beskytte sensitiv informasjon under oppretting av testdata.

- skalerbarhet: Forskningsgruppen testet om verktøy kunne håndtere både små prosjekter og behov på bedriftsnivå uten at det gikk på bekostning av ytelse eller stabilitet.

- Støtte på tvers av plattformer: Vi inkluderte bare verktøy som er bekreftet å kjøre sømløst på tvers av flere operativsystemer, databaser og skymiljøer.

- Valuta for pengene: Vi analyserte kostnad kontra funksjoner for å anbefale verktøy som gir maksimale fordeler uten unødvendige kostnader for organisasjoner av ulik størrelse.

Slik feilsøker du vanlige problemer med testing Generator Verktøy?

Her er noen av de vanlige problemene brukere møter når de bruker testgeneratorverktøy, og jeg har gitt de beste måtene å håndtere dem på under hvert av problemene:

- Utgave: Mange verktøy genererer ufullstendige eller inkonsistente datasett, noe som forårsaker testfeil i komplekse miljøer.

Løsning: Konfigurer alltid regler nøye, valider utdata mot skjemakrav, og sørg for at relasjonell konsistens bevares på tvers av alle genererte datasett. - Utgave: Noen verktøy sliter med å maskere sensitiv informasjon effektivt, noe som fører til samsvarsrisikoer.

Løsning: Aktiver innebygde maskeringsalgoritmer, verifiser gjennom revisjoner og bruk anonymisering på feltnivå for å beskytte personvernet i regulerte miljøer. - Utgave: Begrenset integrasjon med CI/CD-pipeliner gjør automatisering og kontinuerlig testing vanskeligere.

Løsning: Velg verktøy med REST API-er eller plugins, konfigurer sømløs DevOps-integrasjon og planlegg automatisert dataklargjøring med hver byggesyklus. - Utgave: Genererte data mangler ofte tilstrekkelig volum til å etterligne ytelsestesting i den virkelige verden.

Løsning: Konfigurer generering av store datasett med samplingsmetoder, bruk syntetisk datautvidelse og sørg for at stresstesting dekker scenarier med toppbelastning. - Utgave: Lisensrestriksjoner hindrer flere brukere i å samarbeide effektivt om testdataprosjekter.

Løsning: Velg bedriftslisenser, implementer delte databaser og tildel rollebaserte tillatelser for å la flere team få tilgang til og samarbeide problemfritt. - Utgave: Nye brukere synes verktøygrensesnittene er forvirrende, noe som øker læringskurven betraktelig.

Løsning: Utnytt leverandørdokumentasjon, aktiver veiledninger i verktøyet og gi intern opplæring for å forkorte implementeringstiden og forbedre produktiviteten raskt. - Utgave: Dårlig håndtering av ustrukturerte eller NoSQL-data resulterer i unøyaktige testmiljøer.

Løsning: Velg verktøy som støtter JSON, XML og NoSQL; valider datastrukturtilordninger; og kjør skjematester før distribusjon for å sikre nøyaktighet. - Utgave: Noen gratis- eller freemium-planer pålegger strenge rad- eller formatbegrensninger på genererte datasett.

Løsning: Upgrade til betalte nivåer når skalerbarhet er nødvendig, eller kombiner flere gratis datasett med skript for å omgå begrensninger effektivt.

Verdict:

Jeg syntes alle verktøyene for testdatageneratorer ovenfor var pålitelige og verdt å vurdere. Evalueringen min involverte en nøye analyse av funksjonene, brukervennligheten og evnen til å oppfylle ulike testkrav. Jeg fokuserte spesielt på hvor godt de håndterer komplekse databehov med konsistens og tilpasning. Etter en grundig gjennomgang var det tre verktøy som skilte seg mest ut for meg.

- EMS Data GeneratorDette verktøyet imponerte meg med balansen mellom rimelighet og brukervennlighet. Evalueringen min viste at det kan generere testdata effektivt for både små og store databaser, og jeg likte hvor brukervennlig det føltes.

- Informatica Test Data ManagementDet er en av de mest avanserte løsningene jeg har jobbet med for oppretting av syntetiske data og robust beskyttelse. Jeg ble imponert over hvor sømløst den automatiserte dataidentifikasjon og maskering på tvers av komplekse databaser.

- DobbeltDet fremstår som et praktisk valg for organisasjoner som trenger strukturert håndtering av testdata. Da jeg brukte det til å organisere store sett med randomiserte datasett på tvers av avdelinger, la jeg merke til hvor mye smidigere testingen ble.