经测试,从Supabase→GPT LOAD→CF防截断→生成接口这样的流程截断概率极低,其他逆向流程都会存在一定量的截断。以下为原版v4.02稳定版及新升级的v4.03内测版供测试(内测版有使用风险,希望大家反馈有效意见提供改进)

geminipowersv35.txt (56.9 KB)

geminipowersv402.txt (112.0 KB)

geminipowersv403.txt (113.9 KB)

核心亮点功能

核心亮点功能

1. 智能流中断恢复系统(RecoveryStrategist)

核心价值: 解决 AI 流式响应中断问题,确保用户获得完整回答

技术特点:

- 三层状态管理架构:PENDING → REASONING → ANSWERING 的智能状态跟踪

- 多维度中断检测:支持 SAFETY、RECITATION、MAX_TOKENS、网络异常等多种中断类型

- 自适应重试策略:根据历史表现动态调整重试阈值和延迟时间

- 内容模式分析:智能识别思维过程与正式回答,优化重试决策

2. 前瞻缓冲机制(Lookahead Buffer)

核心价值: 确保响应完整性,防止重要内容丢失

技术实现:

- 令牌安全检测:提前检测

[RESPONSE_FINISHED]完成标记 - 内容清理:自动移除内部标记,向客户端提供纯净内容

- 顺序保障:维护 SSE 流的正确事件顺序

3. 元认知干预协议

核心价值: 处理复杂推理失败,通过自我反思突破生成瓶颈

工作原理:

- 失败模式检测:识别重复的内容策略问题

- 自批判机制:要求模型在

<self_critique>标签内进行自我分析 - 策略重构:基于反思结果生成全新回答路径

4. 高级缓存破坏技术

核心价值: 减少 429 限流错误,提高 API 成功率

实现方式:

- 时间戳注入:在用户消息末尾添加唯一时间标识

- UUID 模式:使用随机标识符避免缓存命中

- 位置可配置:支持前缀或后缀注入模式

5. 函数调用透传模式

核心价值: 完美支持工具调用,绕过不必要的重试逻辑

6. 思维过程智能处理

核心价值: 优化带思维链的 AI 响应,提供更清晰的用户体验

功能特点:

- 思维吞没模式:重试后可选择性过滤思维过程

- 客户端兼容性修复:移除仅思维块中的误导性 finishReason

- 内容分类跟踪:区分思维过程与正式回答内容

7. 线程安全写入队列

核心价值: 防止并发写入冲突,确保流数据完整性

技术实现:

- 队列化写入:所有写入操作进入安全队列

- 溢出保护:防止队列无限增长导致内存问题

- 优雅关闭:确保所有数据完整发送后再关闭连接

8. 多环境部署支持

部署灵活性:

- Cloudflare Workers:边缘计算部署

- Cloudflare Pages Functions:静态站点集成

- Deno 运行时:本地开发和测试

- 动态路由:自动识别 pro 和标准 API 端点

9. 综合监控与诊断

运维友好特性:

- 心跳监控:SSE 连接健康检测

- 性能指标:延迟、成功率、重试模式分析

- 智能洞察:自动生成故障模式报告

- 请求追踪:唯一 ID 跟踪完整请求生命周期

操作步骤

操作步骤

1、生成Supabase多模型API代理

https://linux.do/t/topic/857003/52

https://linux.do/t/topic/857003/53

https://linux.do/t/topic/857003/54

https://linux.do/t/topic/857003/55

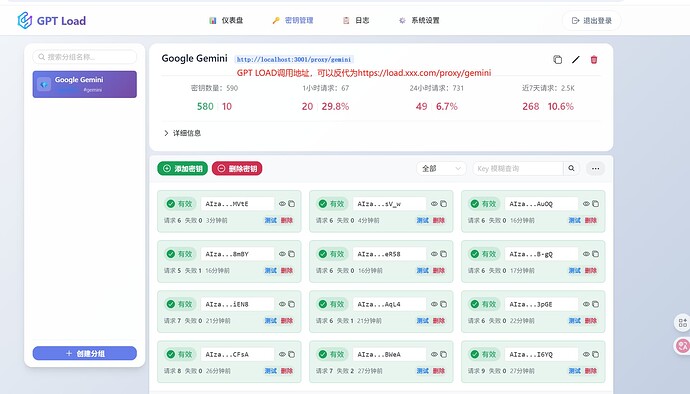

2、部署Gpt load项目,将第1步生成的地址(最后加/gemini)填入GPT LOAD

3、部署Cloud flare防截断项目,将前述代码全部粘贴进去

4、设置两个环境变量及解析调用地址(动态路由:可以设置相同或者不同两种路由代理,pro模型默认走upstream_pro_url_base,普通模型默认走upstream_url_base)

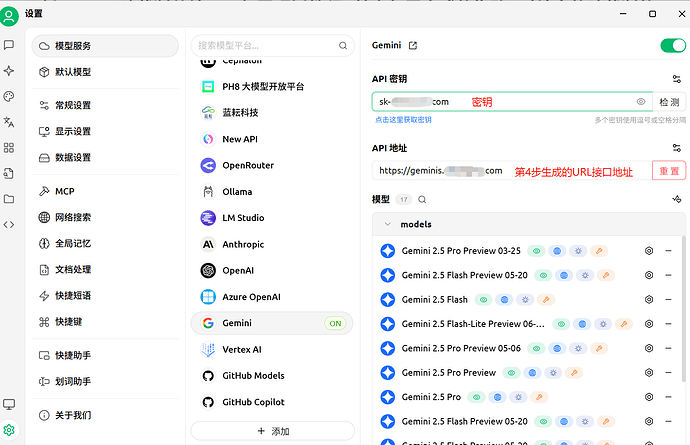

5、将第4步中最后解析调用地址(截图中的workers dev地址或者自定义域)任一个填入Cherry Studio,密钥填写第2步设置的密钥 不建议经过NEWAPI等二转工具中转增加截断率

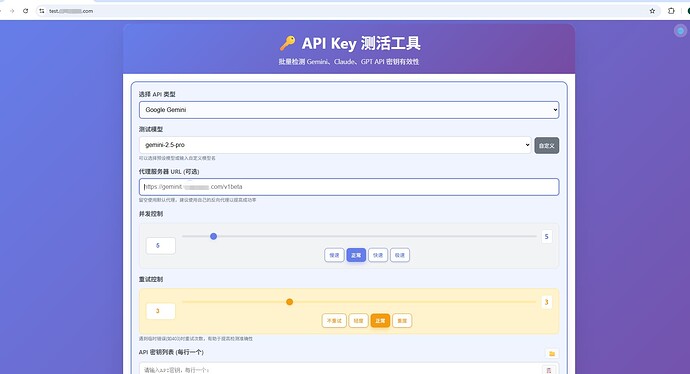

cosplay了一个测评网站,测评效果较好,测评成功基本就能用。

本贴吸收了下贴各位大佬的相关意见及反馈修改,希望积极反馈意见。

https://linux.do/t/topic/836702