5 个赞

去用groq ![]()

20B的参数都量化成什么样子了啊

上次哪位佬说有闲置的算力,期待部署一个

不太行呀

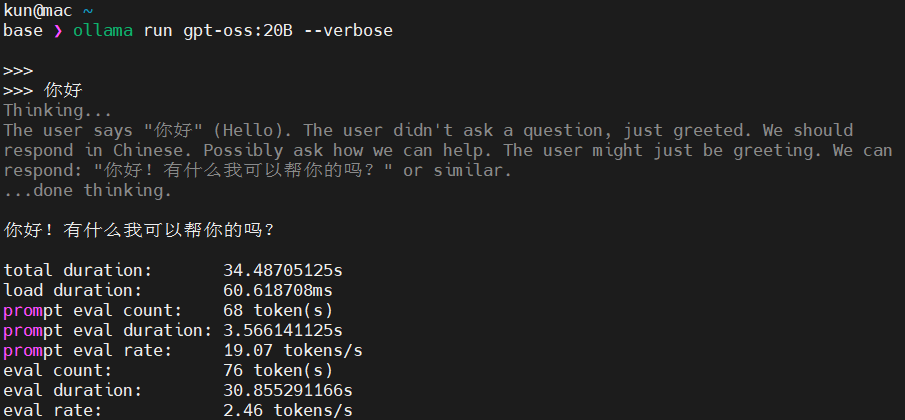

这是什么软件啊

ollama

我去,看了一下ollama更新了

但是ollama上的模型好少

ollama可以直接从hugging face拉模型的

啊? 有教程吗,佬,不是需要转译吗

部分直接就是gguf格式,可以直接用

hugging face甚至做了集成的……

1 个赞

感谢,我看看

别难为自己了,我M4 PRO 48G 跑个4bit量化的DeepSeek r1 都半天没反应

r1 671b 的超大模型和这个 20b 不是一个量级的,佬的 m4 pro 跑这个应该挺快

能跑起来已经算不错了 我24g的跑8x7b的q4km都没反应… 基本上低于128g的mac最好找>=20g以内的模型 超过<=20g都很慢~

我本来也想回去试试我的m3 16gb,劝退了。

hugging face 找 gguf 的格式的模型 然后右上角 use this model 那个功能菜单点开 local app 下面有 ollama 就可以直接复制粘贴到 ollama 使用了~

1 个赞

嗯,刚刚研究了,谢谢

1 个赞

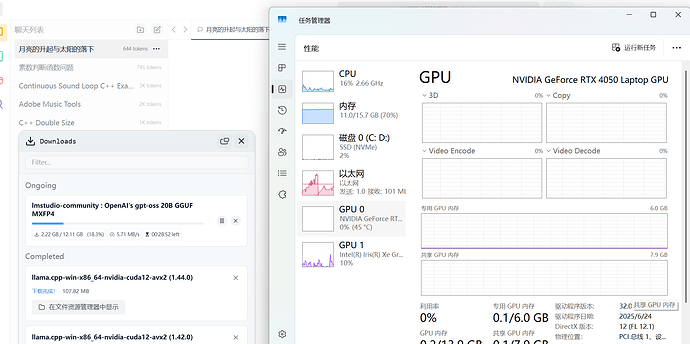

m4 16g 20b本地效果 lmstudio官方GGUF, 关闭了其他占内存的软件:

![]()

整体系统会变卡, 但不影响输出速度