MIT在预印本上发表了一篇超长的论文,漂浮在ChatGPT之上的你的脑子:使用AI助手完成作文写作任务时对大脑的影响之认知负债的累积

Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task

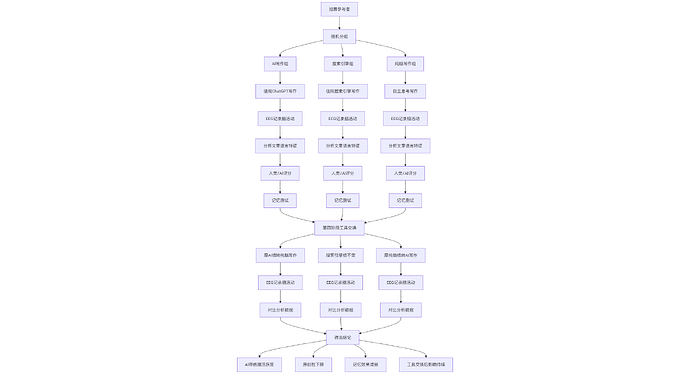

该研究旨在探究教育环境中在生成式AI的帮助下完成写作任务所产生的认知负荷。研究人员将受试人员分为三组:LLM组、搜索引擎组和纯人脑组,三组人员分别使用指定的工具(纯人脑组不使用工具)完成论文写作任务。每位受试者进行了三轮相同分组的任务,第四轮要求LLM组不使用工具完成写作任务,纯人脑组使用LLM完成写作任务。研究采用了脑电(EEG)记录了受试者的大脑活动情况来评估他们的认知投入、认知负荷,并尝试深入了解受试者在写作期间的神经活动。

论文很长,去掉文献引用和数据都有140+页,我就参照论文中的太长不看建议,只看了Abstract、Discussion和Conclusion部分。个人认为比较重要的几个结论:

- 人脑组的论文有很强的多样性,而LLM组在每一个主题中的论文都表现出统计学意义上的同质性

- 由于研究中增加了时间压力,受试者需要在有限时间内完成写作,LLM和搜索引擎组在行为上表现为专注于复制粘贴

- 人类教师裁判对于LLM论文的原创性和结构持怀疑态度,而AI裁判在独特性和质量上给予了更高的评分。人类教师在没有被告知哪些文章是什么组的情况下,能够识别出LLM生成的文章(写作风格)

- 脑电分析显示,大脑的功能连接性随外部认知辅助程度的增加而系统性下降,人脑组表现出最强且广泛分布的功能网络,搜索引擎组表现出中等程度的神经活动参与,LLM组表现出最弱的整体神经耦合

- 在文章归属感方面,LLM组表现出碎片化和冲突的归属感,将内容委托给LLM生成扰乱了原本的元认知环路,导致个体在心理上与书面输出产生解离感

- 使用LLM工具在任务早期促进了技能习得,但没有实现与人脑组相似的深层神经整合。从教育干预角度出发,提示我们,应将 AI 工具的使用与无辅助的学习阶段相结合。在初期自我驱动学习之后,再引入 AI 工具可能更有利于激发认知参与和神经整合

- 对LLM组移除AI工具后,显著削弱了LLM组参与者的任务执行能力。78%的受试者无法回忆任何相关内容,仅有11%被试能准确引用内容。纯人脑组的数据刚好相反,11%的被试无法回忆,78%的被试能够准确引用。神经生理分析表明,习惯性依赖 LLM 工具可能损害特定行为能力,特别是需要深层语义加工与源定位能力的任务,如引用

- 本研究进一步指出三个关键结论:

- 早期依赖 AI 可能导致浅层编码。(就是本来该人脑负担的认知和学习,被AI做了,人脑没有深度加工)

- 推迟 AI 介入可促进记忆形成。(先不用AI进行学习和完成某项任务,等到对学习材料和任务相关材料有了记忆,再用AI,可以激活已有的记忆路径)

- 先纯人脑后用AI的被试组展现出更高的元认知参与(纯人脑组在后期使用AI时能够将AI的结果和过往经验进行比对,激活自我反思和精细加工,也就是批判性思考)

最后,论文提出,这些结果支持一种教育策略,在学习初期阶段延迟引入 AI 工具,优先促进自我驱动的认知建构。此种模式可在不牺牲工具效率的前提下,最大化长期神经发展与认知自主性(cognitive autonomy)

论文最后写到,使用LLM可能会积累认知负债,但这不是唯一要关注的问题,因为LLM还很耗电。根据2023年的一项研究,一次LLM查询所消耗的能量大概是一次搜索查询的10倍。这部分电能成本也是要消费者来买单的。

LLM组每次查询消耗0.3Wh电,搜索引擎组消耗0.03Wh的电。LLM的碳排放更是搜索引擎的340倍。