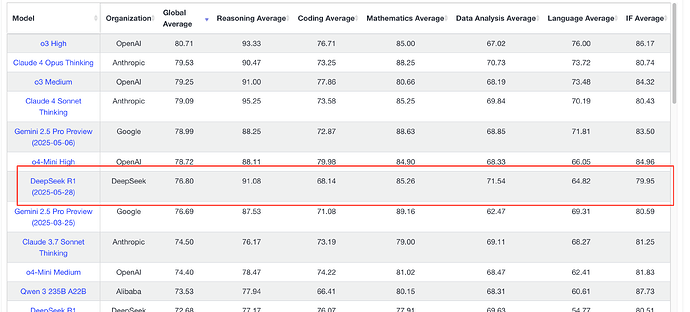

LiveBench编程评分 250530 20:16更新

来源:LiveBench

模型下载

来源:deepseek-ai/DeepSeek-R1-0528 · Hugging Face

评分

官方自评

Function call性能:Tau-bench score: 53.5 (Airline)/63.9 (Retail)

复杂推理问题相比老版本R1会使用更多tokens

来源:DeepSeek-R1 更新,思考更深,推理更强 | DeepSeek API Docs

来源:https://api-docs.deepseek.com/zh-cn/updates

FictionBench长上下文评分

长上下文一直不是Deepseek强项,毕竟免费服务,长上下文会导致成本暴增,但对比r1,在32k以内的上下文性能还是有明显提升的

来源:Fiction.live

Artificial Analysis评分

来源:https://artificialanalysis.ai/

Lmarena评分,截止到250529 18:55未上线

来源:Overview Leaderboard | LMArena

Aider编程评分,截止到250529 18:55未上线

来源:Aider LLM Leaderboards | aider

Chat渠道

官网Chat已上线

来源:deepseek.com

OpenRouter Chatroom已上线

来源:OpenRouter

API渠道

官网API已上线

官方网站、小程序、App 端和 API 中的模型上下文长度仍为 64K。

可以通过其他第三方平台调用上下文长度为 128K 的开源版本 R1-0528 模型。

官方R1 API 中max_tokens参数,用于限制模型单次输出的总长度(包括思考过程),默认为 32K,最大为 64K。暂不确定如何单独指定推理token数

参考2.5pro/sonnet4最大总输出都是64k,opus4是32k,o3/o4-mini是100k

OpenRouter已上线

上下文164k,输出一般是32k

训练数据问r1自称到24年7月

有多个供应商,价格与r1-0120基本相当

免费版:R1 0528 - API, Providers, Stats | OpenRouter

收费版:R1 0528 - API, Providers, Stats | OpenRouter

L站一些相关讨论传送门

.deepseekr1 0528和2.5p以及claude4o比那个更强

.【已更新】一招分辨新旧DeepSeek R1

.新版DeepSeek R1思考极限时长能达到24分钟52秒

.DeepSeek R1写代码已经超越Claude

.DeepSeek-R1-0528 发布了,我吓得摔了一跤(重开)

.roocode搭配deepseek R1 0528,省钱好用!

.DeepSeek-R1-0528太勾巴强了,随便让生成一个rpg就出来这么个东西,试了下真能玩

.https://linux.do/t/topic/686739