之前跟老婆一人一张3080 10g打游戏,现在淘汰下来了,想组装成一台家庭服务器,用来专门跑本地模型玩玩.请问两张显卡怎么才可以跑到32b的模型啊呢,求教.

单卡跑14b是勉强可以跑的,测试过.不过可能上下文不多,因为马上爆显存了在windows11上

14 个赞

显存不够可以跑量化模型试试,r1应该有量化的吧

经常跑感觉电费不够呀

5 个赞

10G 32B不够的 我14G单卡 32G内存 跑14B勉强~

只能跑量化了,而且多卡推理似乎和单卡推理部署的时候还不太一样,需要专门学一下

4 个赞

QwQ-32B-GGUF 4bit 19.9G 你可以试试

4 个赞

量化后的和傻子一样,不如直接玩小模型

5 个赞

ollama run的默认是q4量化,你截图的也是q4,32B差不多都20GB,硬是想跑的话可以找别人量化的q3,大概16GB,比如:ollama run MHKetbi/unsloth-QwQ-32B:q3_K_M

另外qwq比r1训练的qwen更好用

1 个赞

直接加显存,改成3080 20g

int8已经是可接受最低标准了啊~32b需要18g显存以上吧

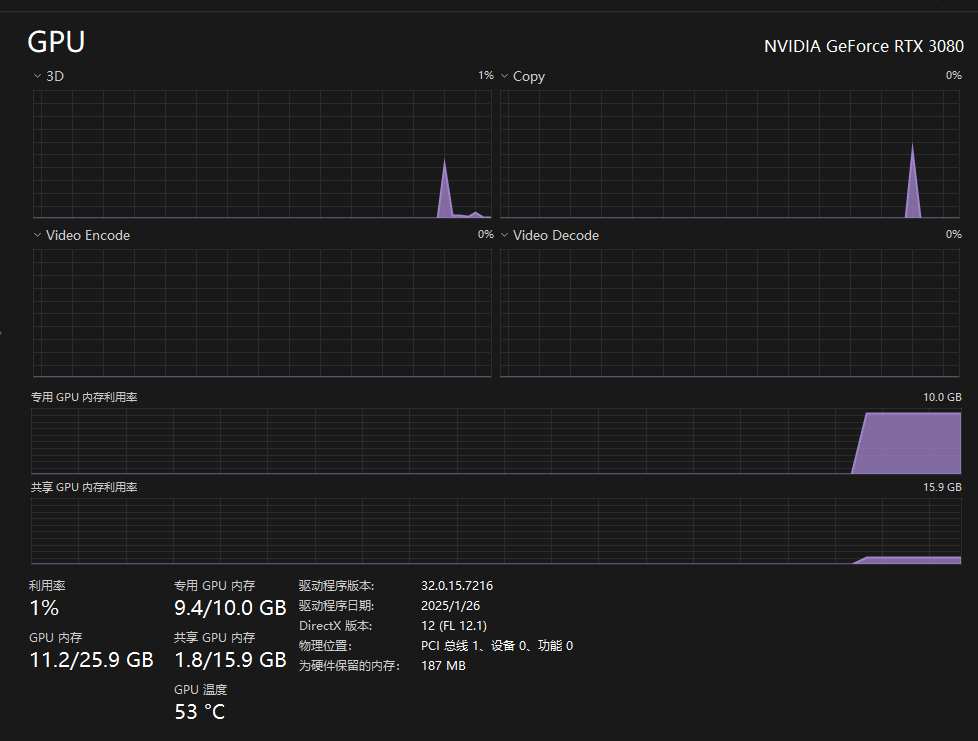

![]() 我这是现成的家用显卡啊

我这是现成的家用显卡啊

受教了,谢谢.

有个版本是3080 20g

找人加焊显存,然後猛猛干。

听说这个挺厉害的,前段时间很多自媒体在吹说接近640b的deepseek

只能说。。。很难,要么使用4bit以下的极致量化,要么只开很小的上下文导致不可用。

话说两张3060总共24g倒是能跑起来。

1 个赞

20G的显存不足以支撑32B的模型,运行14B倒是绰绰有余,看佬友调试什么。如果想体验32B或者70B的模型,我建议是网上寻找野生的Ollama,有好的速度飞快的。

1 个赞

之前跑过一个q5的qwen还行

10g显存不如狗啊,唉

感觉显卡厂商都协议好了不出大内存。现在要是放开一些24G以上的,那个人模型会普及很多把

改装可以改,只要发过这个版本的驱动

2080ti 22g就是这么来的

为啥要折磨自己??

中国做不出来的东西就是这样…

当年SSD卡死在512和1T多久了,一个三星高配1T卖我1800,我的ps5捏着鼻子买的.