厉害好佬,请问一下服务器配置

不是服务器,而是普通电脑

1 个赞

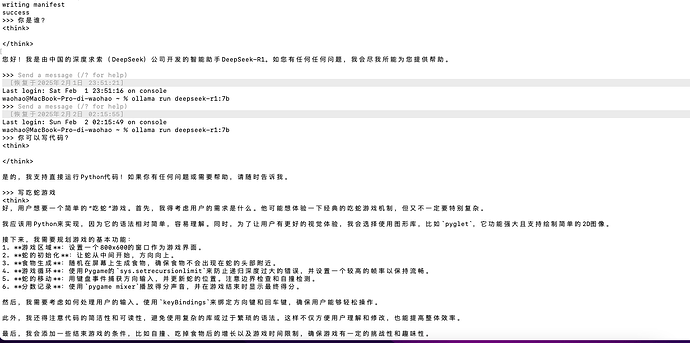

/set verbose

然后可以看输出token的速度。我 8845H+4070 笔记本,输出大概在 3tps 左右, deepseek-r1:32b模型

deepseek-r1:32b真牛啊

我还以为是原版模型,7b蒸馏版没啥意思

哦。好吧

哇!太强了!

自己部署玩玩挺有意思的

1 个赞

个人版能部署得了原版那都是大大大佬

1 个赞

4060笔记本7b能跑41.03 tokens/s

1 个赞

mac mini4 32g跑deepseek-r1:14b,刚刚够用吧,有空试试deepseek-r1:32b

total duration: 9.300456167s

load duration: 25.790875ms

prompt eval count: 23 token(s)

prompt eval duration: 350ms

prompt eval rate: 65.71 tokens/s

eval count: 101 token(s)

eval duration: 8.76s

eval rate: 11.53 tokens/s

7b确实差点

大佬真强!

听说ds完全听不懂让它不要擅自发言的指令,不知道本地部署会不会有一些改观。

mac mini4 32g跑deepseek-r1:32b,速度有点慢

total duration: 20.803752458s

load duration: 26.818208ms

prompt eval count: 24 token(s)

prompt eval duration: 888ms

prompt eval rate: 27.03 tokens/s

eval count: 103 token(s)

eval duration: 19.723s

eval rate: 5.22 tokens/s

我很好奇。。。32B。。不是要24g+的显存么?这是部分加载到内存了么?

是的,这种常被称为“混合精度计算”或“逐层加载”

在 OpenI的云服务器Ollama用 32B的模型,40G的显存全跑满,基本是蹦字,一分钟能出1到2个token,

32B没用ollama的原模型,云服务下载太慢了,用的云上的DeepSeek-R1-Distill-Qwen-32B