就玩玩跑团这种文字游戏用,我这边显卡是3080ti laptop 16g,有推荐的模型吗?

37 个赞

本地的可能不够啊

3 个赞

同问想跑跑酒馆玩玩,有啥本地模型比较好用吗?

1 个赞

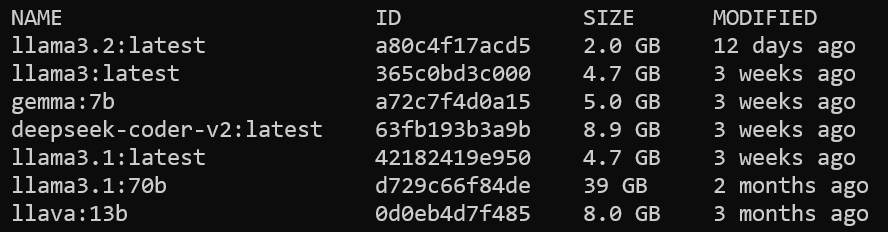

用 ollama 部署 qwen2.5 14b 试试

可以试试 qwen2.5 7b 的量化模型,非量化应该显存不够

1 个赞

问下佬们,大概多少显存能跑,4070TiSuper 16G 够不够

1 个赞

大佬,你这个怎么安装使用的,有教程不?

中文的glm-4-9b,qwen-2.5-14b

8GB可以跑7b上下的模型,16, 32, 64 以類推

1 个赞

qwen还是可以的

感谢您,感谢分享

玩ollama不玩破限?试试这个,直接ollama run 接上后面的model名称就好,包括hugging face

hf.co/QuantFactory/Qwen2.5-7B-Instruct-Uncensored-GGUF:Q8_0 8.1 GB

目前qwen2.5可能是比较好的选择

很方便,感谢分享

1 个赞