前言:在站内看到很多佬都写了该教程,但是没有明确写Linux环境部署,且我个人看到的大多数教程都需要开本地代理(可能看的不仔细,勿喷)我就写一篇简单的,新手一看不容易被吓退的文章

我是从这里学的:cpa保姆级教程,cc接入gpt

1.下载安装CPA

从git上下载linux相关的发布版本,上传至服务器任意目录

执行

chmod +x ./cli-proxy-api,给予执行权限,再执行cp config.example.yaml config.yaml,复制一版配置中文件出来,执行vi config.yaml对配置文件进行编辑,配置CPA管理控制台的密钥配置完成之后,ESC,:wq保存,然后执行./cli-proxy-api即可。看到

API server started successfully on: 0.0.0.0:8317相关日志输出,或没有报错,就可以尝试访问ip:8317了。如果要后台挂起运行的话找AI写个shell脚本即可。

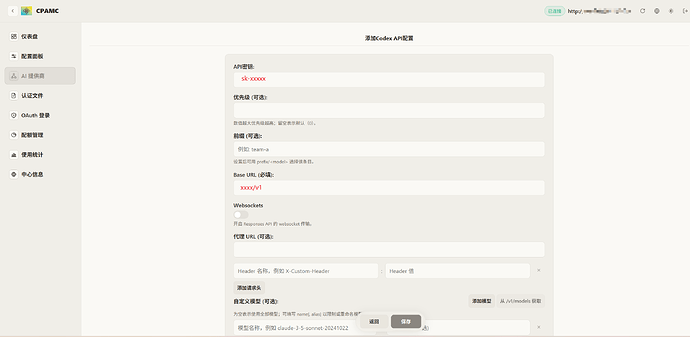

2.配置API渠道

访问IP:8317/management.html,使用刚刚填写的密钥进行登录,切换到AI提供商,点击CodexAPI配置,点击添加配置,API密钥输入你中转站或者cch的密钥,baseUrl填写中转站的cx地址或者cch的地址即可

然后点击保存即可。

补充一下,远程访问的话还需开启这个配置,这个配置默认是false

remote-management.allow-remote: true

或者在管理控制台-配置面板勾选允许远程访问即可:

3.生成密钥

进入配置面板,滚动下拉,找到API密钥列表,在此处添加或编辑即可,原先应该有三个示例密钥,可以删除。添加之后复制密钥准备做下一步操作

4.cc-switch配置(直接settings.json配置也可以)

选中Claude,点击新增,API Key输入刚刚在CPA新增复制的密钥,请求地址填写http://ip:8317即可,API格式与认证字段默认,模型等都填写gpt-5.4,或gpt-5.4(xhigh),或gpt-5.2-codex,填写codex中有的gpt模型id即可,括号内是思考深度(额外提问,到底是gpt5.4好还是gpt5.2-codex好?菜鸡体验不出来差别)

这样就大功告成啦,打开终端,输入claude,询问,你是什么模型?

完事!!!我个人是一开始一直用的cc,所以对cc的交互,界面,展现形式,工具都比较喜欢,所以用了这种方式,而且cc跟人的交互感觉比cx要好不少(个人认为)还有什么其他cc用gpt模型的优点吗