————2026年3月4日15:40:25

小模型适合单元开发,就是那种几千行(之间的)的代码修改,不合适。

还是不如在线模型稳定。

总来说,Qwen3.5:9b在Agent之间调用已经非常够用了,很适合做端侧“贾维斯”。

在写代码方面,对于已经习惯在线模型的我来说,不太能忍受它对于“核心语义”的“二次需求”的解构能力的丢失。

到这里,9b的能力上下限基本上测试完成了,可以知道端侧智能体的强大后端,再去调用各种端侧模型,基本上定位就是这样了。

欢迎交流~

————2026年3月4日15:00:38

qwen3.5出来之后,我打算再用多模态3.5:9b洗一下这个数据。

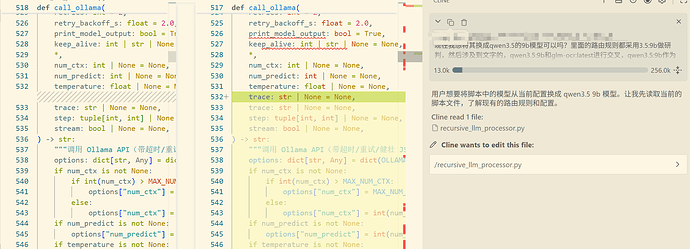

然后我的Prompt在Cline是:

DOJ/recursive_llm_processor.py

现在我想将其换成qwen3.5的9b模型可以吗?里面的路由规则都采用3.5:9b做研判,然后涉及到文字的,qwen3.5:9b和glm-ocr:latest进行交叉,qwen3.5:9b作为refineder,然后图像识别就只用Qwen3.5:9b进行,因为现在我们已经有相关的描述,因此,我们现在的任务是不仅仅要读取原有的pdf或者视频,还要,根据原有的结果,进行更加详细的补充,文本量要原来的3倍,更加细致。请你帮我优化一下这个脚本。

然后就基本上代码替换就是一秒左右一行,很慢,体感很差经。

内网服务器。

————2026年3月4日14:15:57更新

Qwen3.5:27b-256k,会“撤回”一开始的输出,然后给出更加全面的分析。

我给的任务是在分析链路上有很多相同关键词重复的分析任务,(开发习惯导致的),一开始3.5以为找到答案了,但是说到一半又继续Thinking了。

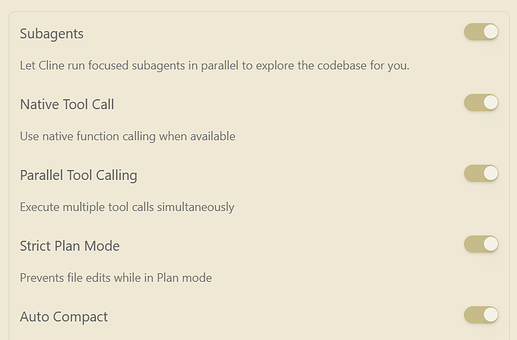

我猜可能跟Cline的一个选项有关:Subagents-Let Cline run focused subagents in parallel to explore the codebase for you.

虽然慢了很多,但给人一种踏实感,跟Codex差不多。

下面是我的Cline选项。

但是还有一个问题,就是:

Qwen3.5仅限于在我们提供的代码上面做分析非常牛逼,但是对于我们的更加上层的“设计意图”分析的没有像在线模型那么牛逼。

————2026年3月4日13:52:53更新

又部署好了Qwen3.5:27b, 256k完全体。

代码是闪出来的。

9b有的时候会卡一下,但是等等还行——在编辑3500行的py文件有些吃力。

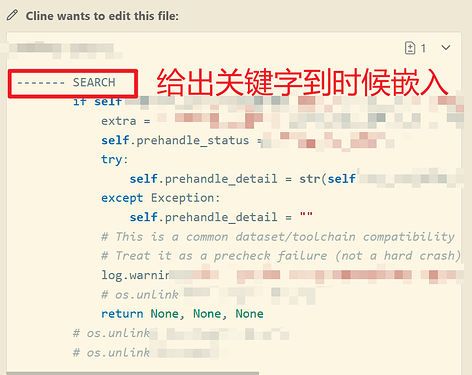

CLine的插件在编辑代码方面真的是一坨,非得重写。

发现原因了,是Cline有一个选项是Background Edit-Allow edits without stealing editor focus。这样就可以只让模型生成代码片段了。

tips:

对了记得要关掉Checkpoint,不然它(Cline)会禁用你的仓库(生成一个.git_disable),好险我有及时推送的习惯,不然我都没法跟踪我的工作了,我这是一个大项目,里面有两个仓库,都给我禁用了。

————2026年3月4日13:12:33

今天在服务器升级了Ollama部署了Qwen3.5:9b,256k上下文。

发现编程体感不亚于Github Copilot,我认为一些比较深入的跨文件分析问题,它能很快的给出答案。(我的分析案例是3层以上的文件调用树)。

还有待进一步深入体感。

在这里震惊一下。