看来字节对于豆包1.8(结合之前回炉过一次)不太满意.

还是256K上下文

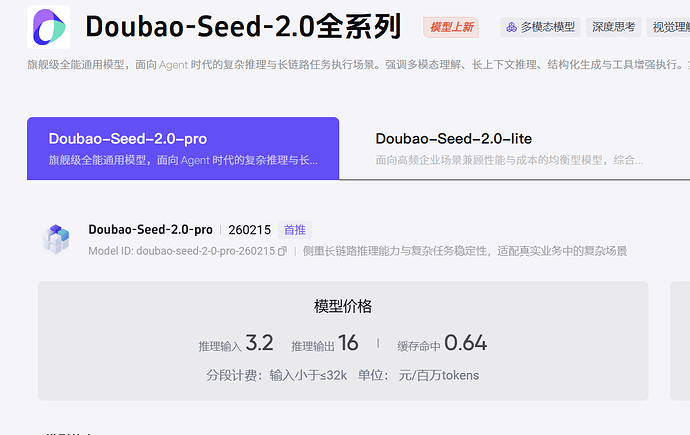

2.0Pro输入比1.8贵4倍,输出比1.8贵8倍(<200字)  .

.

2.0lite整体比1.8要便宜(经Likerainer佬提醒),性能也比1.8要强,刚公测的1.8就要入土为安了  .

.

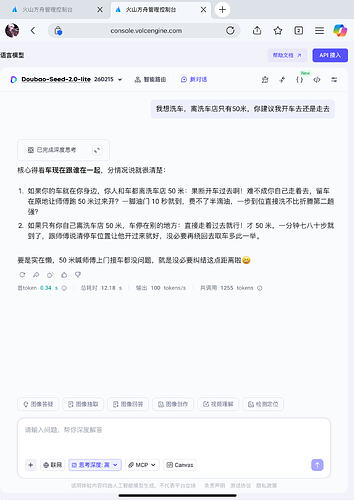

PS:个人之前非常喜欢用1.8,多模态,便宜,性能在飞书多维表里面字段单元格级别任务绰绰有余,几千行数据,识发票, 银行对账, 原始数据清洗去噪音, 完全不用担心钱包,单元格级处理, 准确率也值得放心。所以豆包1.8可能定位就是丢在飞书多维表里做小规模多频次推理用的,比如总结单元格内容,替换或者提炼单元格字符,这种<200token的任务1.8非常有性价比了。

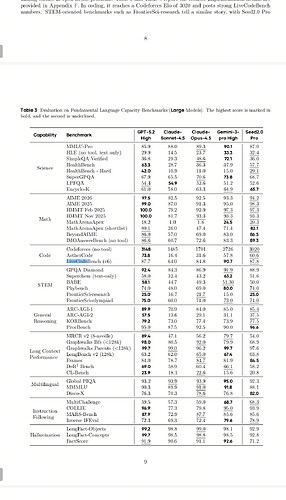

相比GLM5和KIMI2.5:

≤32k

- 豆包2.0 Pro:0.144 元(最便宜)

- GLM-5(≤32k档):0.170 元

- Kimi2.5:0.185 元

结论:没超 32k,还是豆包2.0 Pro 最省。

32k~128k

- Kimi2.5:0.362 元(最便宜)

- 豆包2.0 Pro(32k~128k档):0.432 元

- GLM-5(>32k档):0.524 元

结论:32k~128k ,Kimi2.5 最省, 豆包2.0Pro比GLM5便宜一丢丢.

128k~256k

- Kimi2.5:0.842 元(明显最省)

- 豆包2.0 Pro(128k~256k档):2.016 元(成本爆炸)

- GLM-5:(>32k档)**:0.524 元

结论:还是Kimi2.5最省;豆包2.0 Pro 成本直接原地爆炸。

| 模型 | 输入档位/条件 | 推理输入 | 推理输出 | 缓存命中 | 缓存存储 | 批量推理输入 | 批量推理输出 | 批量推理缓存命中 |

|---|---|---|---|---|---|---|---|---|

| 豆包 2.0 Pro | 输入≤32k | 3.2 | 16 | 0.64 | 0.017 | — | — | — |

| 豆包 2.0 Pro | 32k<输入≤128k | 4.8 | 24 | 0.96 | 0.017 | — | — | — |

| 豆包 2.0 Pro | 128k<输入≤256k | 9.6 | 48 | 1.92 | 0.017 | — | — | — |

| 豆包 2.0 lite | 输入≤32k | 0.6 | 3.6 | 0.12 | — | — | — | — |

| 豆包 2.0 lite | 32k<输入≤128k | 0.9 | 5.4 | 0.18 | — | — | — | — |

| 豆包 2.0 lite | 128k<输入≤256k | 1.8 | 10.8 | 0.36 | — | — | — | — |

| 豆包 1.8 | 输入≤32k,输出≤200 | 0.8 | 2 | 0.16 | 0.017 | 0.4 | 1 | 0.16 |

| 豆包 1.8 | 输入≤32k,输出>200 | 0.8 | 8 | 0.16 | 0.017 | 0.4 | 4 | 0.16 |

| 豆包 1.8 | 32k<输入≤128k | 1.2 | 16 | 0.16 | 0.017 | 0.6 | 8 | 0.16 |

| 豆包 1.8 | 输入>128k | 2.4 | 24 | 0.16 | 0.017 | 1.2 | 12 | 0.16 |

| GLM-5 | 输入≤32k | 4.0 | 18.0 | 1.0 | 限时免费 | — | — | — |

| GLM-5 | 输入>32k | 6.0 | 22.0 | 1.5 | 限时免费 | — | — | — |

| Kimi-k2.5 | 输入≤256k | 4.0 | 21.0 | 0.7 | 未披露 | — | — | — |