刚看到文心一言超越GPT4o了,心头一紧 ![]()

大模型榜单掺水的实在太多,导致很难选择自己中意的模型。

目前比较客观的、权威的、很难注水的榜单,我比较看好以下的:

1. OpenCompass 司南大模型评测体系

官网:https://rank.opencompass.org.cn/home

只做简单介绍,具体可以看官网。

OpenCompass大模型开放评测体系是上海人工智能实验室推出的完整开源可复现的评测框架。作为 OpenCompass 中各类榜单的承载平台,CompassRank 不受任何商业利益干扰,保持中立性。同时,依托 CompassKit 工具链体系中的各类评测手段,保证了 CompassRank 的客观性。CompassRank 不仅覆盖多领域、多任务下的模型性能,还将定期更新,提供动态的行业洞察。与此同时,OpenCompass 团队将在榜单中提供专业解读,进一步帮助从业者理解技术深意,优化模型选择。

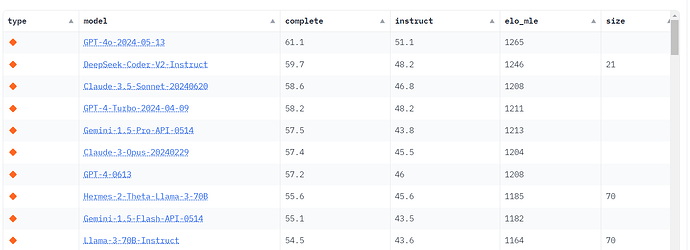

下面是最新的榜单(代码能力,deepseek ![]() 可以一战):

可以一战):

附上一篇文章: 账号已迁移

2. BigCodeBench

官方榜单地址:BigCodeBench Leaderboard - a Hugging Face Space by bigcode

简单介绍: HumanEval是一个用于评估大型语言模型 (LLM) 在代码生成任务中的参考基准,因为它使得对紧凑的函数级代码片段的评估变得容易。然而,关于其在评估 LLM 编程能力方面的有效性越来越多的担忧,主要问题是 HumanEval 中的任务太简单,可能不能代表真实世界的编程任务。相比于 HumanEval 中的算法导向任务,真实世界的软件开发通常涉及多样的库和函数调用。此外,LLM 在 HumanEval 上的表现还受污染和过拟合问题的影响,这使得其在评估 LLM 的泛化能力方面不够可靠。BigCodeBench 的发布,它可以在没有污染的情况下评估 LLM 解决实际和具有挑战性的编程任务的能力。具体来说,BigCodeBench 包含 1140 个函数级任务,挑战 LLM 遵循指令并将来自 139 个库的多个函数调用作为工具进行组合。为了严格评估 LLM,每个编程任务包含 5.6 个测试用例,平均分支覆盖率为 99%。

以下是最新榜单(deepseek ![]() 牛啊):

牛啊):

补充:

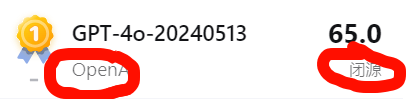

3.Chatbot Arena

感谢null在楼层的补充,lmsys确实是当前认可度最高的,由于帖子没有把竞技场放进来,所以一开始没放lmsys,现在作为补充,供大家了解最客观的榜单。

chatbot arena https://chat.lmsys.org

最真实可信的毫无疑问是Chatbot Arena。Lecun,Karpathy,Ilya等大神和Altman等人都认可这个榜单。这个榜单是人类盲测的,且测评的网友数量是所有榜单中最多的。我自己使用这些llm的感受也和arena的leaderboard一样。