开你个西瓜 大头

大头

泪目啊,好久咩发文了,最近一段时间忙+懒,其实我也赞了好多文章,结果都没发出去 =,= 懒癌又发作了,我觉得我可能是松鼠性格,爱凑着~

下面主要测试了

Cursor、Augment做横向对比和模型测试,测试下来,效果居然有一点点不错哎,特别是在

Cursor,为什么在Cursor里面测试呢,我考虑了代码索引这个最重要的东西,在Cline和RooCode里面总是少点感觉:代码索引,索性就用Cursor来测试他的完整能力,绝对不是懒得配置 =,=

模型优劣势横向对比

| 对比维度 | MiniMax-M2 | Claude C4.5 | GLM4.6 |

|---|---|---|---|

| 响应速度 | 约80tokens/秒,速度极快 |

中等速度 |

较慢(官方严重卡顿) |

| 代码生成能力 | 代码质量良好,代码索引精准 |

代码生成稳定可靠 |

代码能力时强时弱(官方断流、降智) |

| 指令遵循度 | 遵循指令,输出结构化 |

指令遵循优秀 |

基本遵循指令 |

| 准确性 | 结果准确度高,分析逻辑清晰 |

准确性极佳 |

准确性良好 |

| MCP工具调用 | 完美支持工具调用,功能强大 |

工具调用稳定 |

工具支持(可能受降智影响) |

| 多轮对话 | 上下文理解良好 |

对话连续性极佳 |

基本对话能力,上下文丢失严重(100k上下) |

| 免费程度 | 限时免费,API调用无限制 |

需要付费(官方牛牛的,反正我推荐尽量走靠谱中转吧) |

有一定免费额度(=,= 想体验就买20那个足够) |

| 集成难度 | 配置相对简单,文档完善 |

一般般(主要番茄 |

配置相对简单,文档完善 |

综合评分

| 模型 | 综合得分 | 推荐指数 | 适用场景 |

|---|---|---|---|

| Claude C4.5 | 4.8/5 | 全场景都牛逼 |

|

| MiniMax-M2 | 4.6/5 | 目前暂定国产T0梯队,未来可期!! |

|

| GLM4.6 | 3.8/5 | 就目前现在这处境官方想办法提高一下稳定性啊 =,= |

总结:MiniMax-M2在速度和功能丰富度方面表现突出,是当前AI编程工具中的T0梯队选择,特别适合需要高效代码生成和多功能集成的开发场景。

M2 注册

创建 API Key

保存密钥

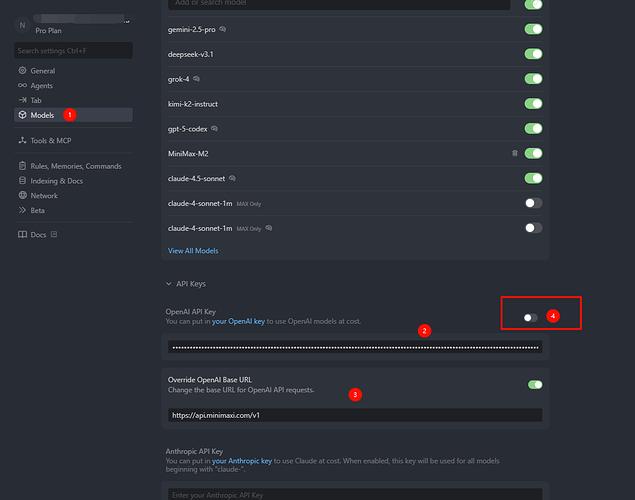

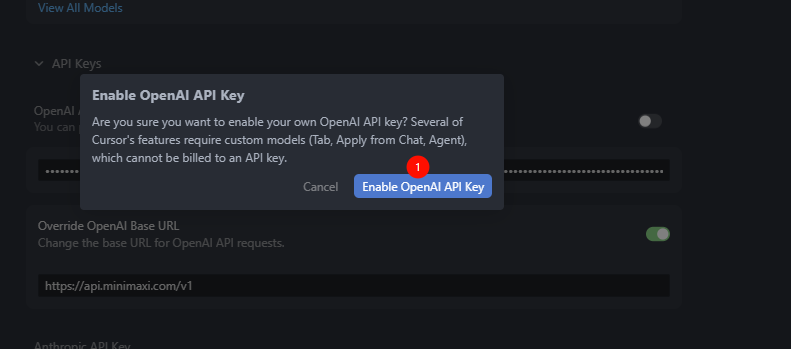

Windows - Cursor 设置

官网的那个版本截图有问题,大家注意看我操作。

配置模型

![[PixPin_2025-10-28_01-20-47.png]]

第四步,一定要勾选

上

添加模型: MiniMax-M2

有人在这一步不太懂,为什么呢,因为没有添加模型的

add我自己摸索了一下需要先搜索,才会出现,这特么不是

bug吗?丢!

这里不知道是不是

Cursor的bug,添加之后不会显示的,但是在chat聊天已经可以看到了了

Curosr 也不知道搞什么,怎么设置界面这么复杂,,,我丢,好像0.xx版本就这样了,都1.x版本这个bug还在?? =,=

Windows - Claude Code 设置

我是

PowerShell终端,下面是我的环境变量设置,直接照抄

安装 Cluade Code

安装前提下

,你安装了

node 22+版本以上

npm install -g @anthropic-ai/claude-code

PowerShell 环境变量配置

#minimax

#官说明:https://platform.minimaxi.com/docs/guides/text-ai-coding-tools

$env:ANTHROPIC_BASE_URL="https://api.minimaxi.com/anthropic"

$env:ANTHROPIC_AUTH_TOKEN="eyJhbGciOiJSUz......."

$env:API_TIMEOUT_MS="3000000"

$env:CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC="1"

$env:ANTHROPIC_MODEL="MiniMax-M2"

$env:ANTHROPIC_SMALL_FAST_MODEL="MiniMax-M2"

更多看官方文档

在 AI 编程工具里使用 M2 - MiniMax API Docs

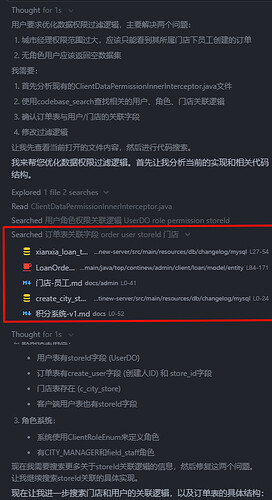

实战 - 小Bug处理

最近在写一个项目,里面有一个权限问题,涉及几张表之间数据捞取,我之前方案是直接写一个

Mybaits 拦截器,用子查询插入(select * from user where user_id = xxx) 类型这种写法

Cursor - M2

在Cursor中的搜索

有一点小惊喜,能准确在Java项目(还是多模块)中搜索到准确和相关的文件(sql、类文件、md文档等),这归功于

Cursor也有代码索引,但是能准确调用并且使用,比GLM4.6稍强。

Tool 工具调用

MCP 调用

Todo list

完整

Augment - C4.5

唔,整体看下来大差不差,没有分析过程,因为

Augment不是用的思考模型

think版本,但是速度比M2慢一点。。。M2是真的快,还是经过Cursor服务中转了一下,输出却有差不多 80/t 离谱,而且最后输出效果还挺好?!挺符合预期的。

完整

小项目生成 - 虚拟卡生成

某虚拟卡生成网站原始JS

带一点混淆和压缩,我只是美化了一下,其他的全靠AI去读和猜~

M2 生成

C4.5 (非思考think版本)

执行情况

M2 一把过

一把过,说明他准确的读取了完整近三千行js代码,并且完整复刻,核心代码

Luhn算法没啥大问题,但是…但是这个问题速度真的快啊,

核心服务文件:

virtual_card.go在差不多3秒就输出来了,我还在看C4.5输出和总结,他就好了

C4.5 一把过

感受到

M2的快之后,再看C4.5突然有一点索然无味,因为核心代码差不多,也都是一口气过编译,代码没有太多要调整的,跟当初GLM4.6还要好,速度更快。国产模型目前已低价 + 高效,真的在不停追平国外这些大厂,也在证明一件事,那就是无脑堆硬件真的不如好好调教~

结论

从实战中中很明显看出来, 遵守指令 M2 跟 C4.5 不分上下,其实我很好奇为什么输出内容M2 跟 C4.5 大差不差?好家伙,是蒸馏了claude多少数据?而且最后每次的总结充满了: c里c气 =,=

我觉得他确实可以暂时跟 GLM4.6国产 T0 ![]() 。

。

免费的?!

我说看不到账单和消耗情况,原来免费调用,让我可要好好的玩玩你有几斤几两~可千万别学GLM4.6断流、降智啊

MiniMax M2 模型 API 限时免费调用!活动截止时间:2025年11月7日 上午 08:00