comfyui indextts2官网,基于ComfyUI可视化工作流引擎的语音克隆应用,支持多人对话,情感控制

什么是IndexTTS 2?

B站bilibili最新开源的语音克隆模型:IndexTTS 2。在之前的文章也多次介绍了该语音克隆模型,是当前语音克隆的顶级语音生成模型。IndexTTS-2 是以一次预训练实现了多语种、零样本、长篇章高保真合成,凭借文本-语音对齐表征与语种-说话人解耦架构,在时长精度、情感控制、中文鲁棒性上取得了领先优势。在IndexTTS V2种支持单人与多人语音克隆,同时还支持情感表述。

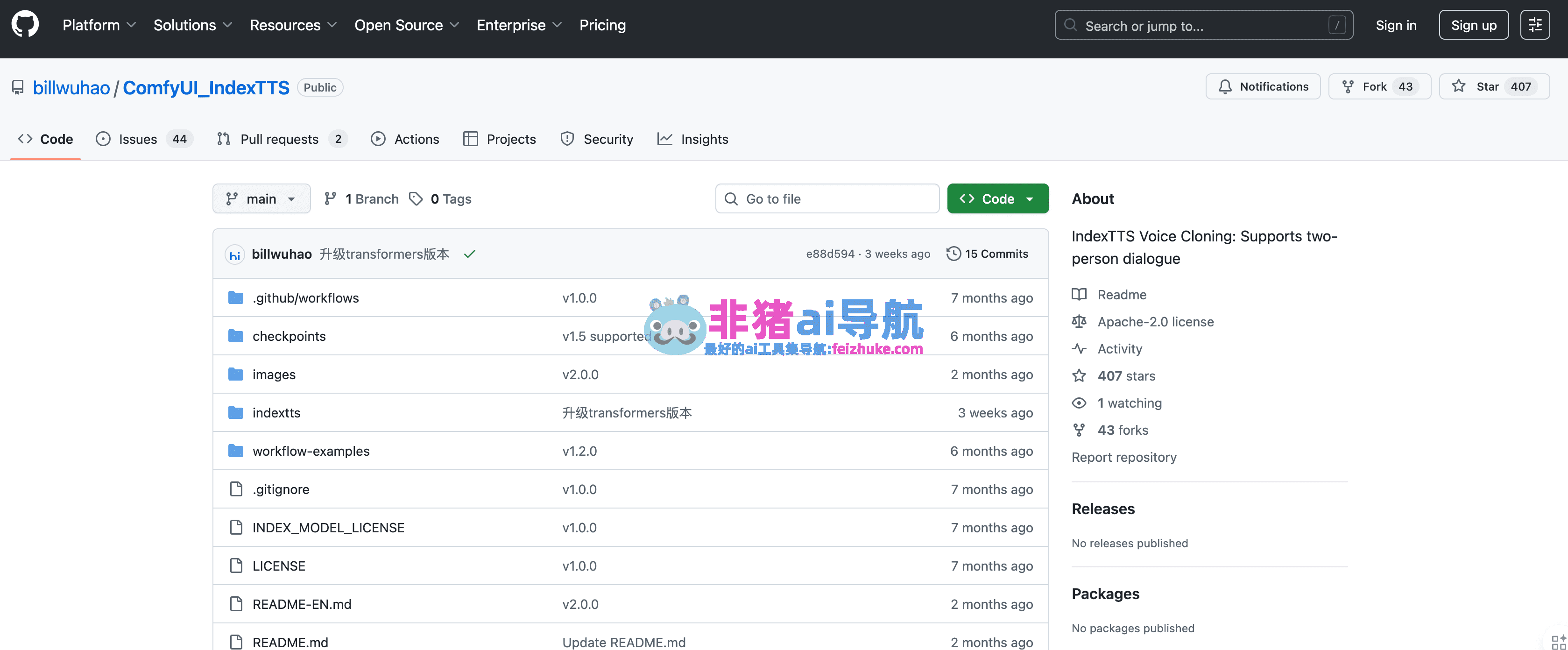

什么是ComfyUI IndexTTS2?

ComfyUI IndexTTS2 是一款基于 ComfyUI 可视化工作流引擎的语音克隆应用,它结合了 IndexTTS2 最新的语音合成技术,能够实现多语种、零样本、长篇章高保真的语音合成。该应用支持单人与多人语音克隆,还可对语音的情感进行精确控制,如开心、悲伤、愤怒等,并且情感强度可调节。其生成速度快,推理速度可达实时率的 3.2 倍,还支持批量处理文本,能显著提高语音合成的效率。

1.「ComfyUI-models-TTS-Index-TTS」整合包下载: 支持单人和多人,情感控制

https://pan.quark.cn/s/ac4601717fd0

2.ComfyUI_IndexTTS官网(需要魔法):https://github.com/billwuhao/ComfyUI_IndexTTS

3.index-tts2一键整合包下载: https://pan.quark.cn/s/692f72e14af1

整合包支持Window和mac,推荐使用整合包

4.IndexTTS官网(需要魔法): https://github.com/index-tts/index-tts

5.IndexTTS2 huggingface在线体验地址: 需要魔法

使用安装说明

抛弃 4090?2025年 RunningHub 保姆级实战指南:让你的破电脑也能跑 Flux 电影级画质

适用人群:显卡冒烟的笔记本用户、受够了报错的 ComfyUI 难民、想在星巴克炼丹的摸鱼党

使用

V2重要参数说明(全是可选的):

-

deepspeed: 是否开启 deepspeed 加速(需要先安装deepspeed)。 -

emo_audio_prompt: 第一个说话人,情绪音频参考。 -

emo_alpha: 第一个说话人,情绪强度。 -

emo_vector: 第一个说话人,情绪控制向量,英文格式输入类似这样的列表[0, 0, 0, 0, 0, 0, 0.45, 0](每一个强度范围0-1,表示惊喜强度 0.45),数字分别对应 : [Happy, Angery, Sad, Fear, Hate, Low, Surprise, Neutral], 几乎无限组合。 -

use_emo_text: 第一个说话人,是否开启提示词控制情绪。如果使用提示词控制,情绪参考音频失效。 -

emo_text: 第一个说话人,情绪控制提示词。随便写,例如哭哭。。。苦苦。。。 -

use_random: 第一个说话人,是否开启随机性。 -

emo_audio_prompt_s2: 第二个说话人,同上。 -

emo_alpha_s2: 第二个说话人,同上。 -

emo_vector_s2: 第二个说话人,同上。 -

use_emo_text_s2: 第二个说话人,同上。 -

emo_text_s2: 第二个说话人,同上。 -

use_random_s2: 第二个说话人,同上。

如果不提供任何情绪控制,自动使用克隆音频作为情绪参考。

重要参数说明(其他参数不是很重要的就不一一介绍了):

max_mel_tokens: 控制生成的语音长度, 长文本需要增加这个参数.max_text_tokens_per_sentence: 分句的最大token数,越小,推理速度越快,占用内存更多,可能影响质量sentences_bucket_max_size: 分句分桶的最大容量,越大,推理速度越快,占用内存更多,可能影响质量fast_inference: 开启快速推理custom_cuda_kernel: 开启自定义 CUDA 内核, 第一次运行将自动构建 CUDA 内核扩展dialogue_audio_s2: 双人会话时的第二个音频, 如果输入这个音频, 自动启动会话模式. 会话模式下, 输入文本必须如下([S1] 表示第一个说话者, [S2] 表示第二个说话者):

[S1] 轻喘像风掠过耳畔,

[S2] 你靠近时,连呼吸都慢了半拍。

[S1] 指尖在我锁骨上游移,

[S2] 仿佛试探一扇未曾开启的门。

- 情绪控制:

- 加载音频:

- 预览说话者:

我将会把所有 TTS 节点的说话者音频全部统一放到 ComfyUI\models\TTS\speakers 路径下, 这些节点包括 IndexTTS, CSM, Dia, MegaTTS, QuteTTS, SparkTTS, StepAudioTTS 等.

- 双人对话:

安装

- Windows 先安装以下依赖:

pynini-windows-wheels 下载相应 python 版本的 pynini 轮子.

示例:

D:\AIGC\python\py310\python.exe -m pip install pynini-2.1.6.post1-cp3xx-cp3xx-win_amd64.whl

D:\AIGC\python\py310\python.exe -m pip install importlib_resources

D:\AIGC\python\py310\python.exe -m pip install WeTextProcessing>=1.0.4 --no-deps

- Linux, Mac, Windows:

cd ComfyUI/custom_nodes

git clone https://github.com/billwuhao/ComfyUI_IndexTTS.git

cd ComfyUI_IndexTTS

pip install -r requirements.txt

# python_embeded

./python_embeded/python.exe -m pip install -r requirements.txt

模型下载

V2模型下载:

模型手动下载到 ComfyUI\models\TTS 下的指定文件夹:

- bigvgan_v2_22khz_80band_256x

bigvgan_generator.pt

config.json

- campplus

campplus_cn_common.bin

- IndexTTS-2

│ .gitattributes

│ bpe.model

│ config.yaml

│ feat1.pt

│ feat2.pt

│ gpt.pth

│ README.md

│ s2mel.pth

│ wav2vec2bert_stats.pt

│

└─ qwen0.6bemo4-merge

added_tokens.json

chat_template.jinja

config.json

generation_config.json

merges.txt

model.safetensors

Modelfile

special_tokens_map.json

tokenizer.json

tokenizer_config.json

vocab.json

- MaskGCT

semantic_codec

model.safetensors

- w2v-bert-2.0

.gitattributes

config.json

conformer_shaw.pt

model.safetensors

preprocessor_config.json

README.md- 模型需要手动下载放到

ComfyUI\models\TTS\Index-TTS路径下:

Index-TTS 结构如下:

bigvgan_generator.pth

bpe.model

gpt.pth

引言

朋友们,咱们说句心里话:你也受够了那个该死的 “CUDA Out of Memory” 了吧?

就在上周,Flux 团队发布了他们最新的微调版本(你懂的,就是那个在 X 上刷屏、号称能把 Midjourney 按在地上摩擦的模型)。我兴冲冲地打开电脑,花了两个小时下载那 30GB 的模型文件,盯着进度条像个傻子一样傻笑。

结果呢?当我把模型拖进 ComfyUI,按下 “Queue Prompt” 的那一瞬间,伴随着机箱里风扇发出的直升机起飞般的轰鸣声,屏幕上弹出了那行熟悉的红字:

torch.cuda.OutOfMemoryError: CUDA out of memory. Tried to allocate 20.00 GiB…

那一刻,我看着桌上那张还在分期付款的 RTX 4070,觉得自己像个笑话。

如果你也经历过这种绝望——为了跑一张图,关掉所有浏览器标签页,甚至不敢动鼠标;或者是为了装一个新的 ControlNet 插件,把整个 Python 环境搞崩,不得不重装系统——那么这篇文章就是为你准备的。

2025年了,大人时代变了。今天我要带你通过 RunningHub 这把钥匙,彻底摆脱硬件的枷锁。不需要 4090,甚至不需要显卡,只要你的电脑能连网,你就能拥有顶级的 AI 算力。

一、 为什么 2025 年我劝你放弃“本地部署”?

在 Reddit 的 r/StableDiffusion 板块,几乎每天都有新人在问:“我想配一台能跑得动最新 Flux 的电脑,预算 1000 美元够吗?”

下面的最高赞回答通常都很残忍:“哥们,1000 美元你连张 4080 Super 都够呛,更别提整机了。” 这就是我们面临的现状。

1. 显存焦虑症:当 Flux 和 SORA 级模型成为标配,24G 显存只是起步价

记得 2023 年那时候,SD 1.5 还是主流,一张 8GB 显存的 3060 就能让我们玩得很开心。但到了 2025 年,模型的参数量级已经不再是线性的增长,而是指数级的爆炸。

现在的“甜点级”模型,比如 Flux.1 Pro 或者是基于 SD3.5 优化的视频生成模型,它们的起步显存需求动不动就是 24GB。这意味着什么?意味着消费级显卡的“王者” RTX 4090 (24GB) 也只是刚刚跨过门槛。稍微上一点高清放大(Upscale),或者加几个 ControlNet 单元,显存瞬间爆红。

我在 X (Twitter) 上看到一位知名 AI 艺术家 @AICat2025 吐槽过:“为了在本地跑一段 5 秒的高清视频,我不得不把显存优化开到极致,生成速度慢得像 PPT,这哪是创作,这是在修禅。”

如果你不是家里有矿能组建 H100 集群,坚持本地部署就意味着你要在这个算力通胀的时代,永远追着硬件跑。

2. “DLL Hell” 噩梦:Python 环境冲突与节点报错的无底洞

即使你咬牙买得起显卡,你在这个行业里还得兼职做一个高级 Python 运维工程师。

ComfyUI 确实强大,但它也是出了名的“脆”。你今天为了用最新的 AnimateDiff v4,升级了 PyTorch;结果明天发现,你最顺手的那个老款 FaceDetailer 插件不支持新版环境,直接报错红屏。

这种痛苦被程序员称为 “Dependency Hell”(依赖地狱)。在 2025 年,随着 ComfyUI 的自定义节点数量突破 5000+,节点之间的冲突简直是家常便饭。

我就问你一个场景:当你灵感爆棚,想马上试一个新出的工作流时,却发现光是解决 pip install 的报错就花了一下午。等到环境终于配好了,你的灵感早就凉透了。我们要的是“画画”,不是“修电脑”,对吧?

3. 移动办公的伪命题:如何在星巴克用 MacBook Air 跑出 4K 视频?

这是一个非常现实的场景:你是自由职业者,或者是像我一样的数字游民。你喜欢带着轻薄的 MacBook Air 在咖啡馆工作。

如果坚持本地部署,你基本上跟“移动办公”说拜拜了。你要么背着十斤重的“习武之人”游戏本(还得随时找电源插座),要么就只能看着别人的作品干瞪眼。Mac 的 M 系列芯片虽然在 2025 年有了很大进步,但在 CUDA 生态统治的 AI 绘画领域,依然是被英伟达按在地上摩擦的弟弟。

而云端 ComfyUI 的本质,就是把算力解耦。

上周我在飞往东京的航班上,用机上 Wi-Fi 连着 iPad,通过 RunningHub 调整好了参数,排队生成了 50 张图。落地的时候,图已经全部躺在我的云端相册里了。这种“轻终端 + 重云端”的体验,一旦你试过,就再也回不去那台像暖气片一样发烫的台式机了。

三、 从零开始:你的第一个 RunningHub 工作流

好,理论课结束。现在把手放在鼠标上,我们开始实操。

很多新手倒在第一步,不是因为笨,而是因为被那些全英文的界面和复杂的注册流程劝退了。但在 2025 年,RunningHub 的门槛其实已经降得很低了,只要你避开几个特定的坑。

1. 注册与避坑:如何解决国内邮箱接收验证码延迟的问题?

第一步是注册。RunningHub 虽然对全球用户开放,但它的邮件服务器有时候对国内的 QQ 邮箱或 163 邮箱不太友好。

-

老手建议:如果有条件,强烈建议使用 Google (Gmail) 或 Microsoft (Outlook) 账号直接 OAuth 登录。这不仅能秒过验证,还能避免未来因为邮件服务商拦截导致的“账号找回死循环”。

-

避坑指南:如果你必须用国内邮箱,请务必把

[email protected](或其他官方发信域名) 加入白名单。 -

羊毛党福利:2025 年 RunningHub 为了抢占市场,新用户注册通常会送 500 Credits(大约能跑 50-100 张 Flux 图)。注册时留意一下是否有“邀请码”输入框,去 X (Twitter) 上搜一下最新的 KOL 邀请码,通常能额外再嫖 200 积分。

2. 界面汉化与基础设置:让英文苦手也能 1 分钟上手

进入工作台(Workspace),映入眼帘的是原生的 ComfyUI 界面——全是英文,甚至连节点名称都是 KSampler、CLIPTextEncode 这种硬核术语。

别慌,我们不需要背单词。

-

必装插件:在右侧悬浮菜单栏里,找到 “Manager” (ComfyUI Manager)。这是 ComfyUI 的应用商店。

-

搜索与安装:点击 “Install Custom Nodes”,搜索

AIGODLIKE。你会看到一个叫AIGODLIKE-ComfyUI-Translation的插件。点击 Install。 -

重启环境:RunningHub 会提示你重启。点击 “Restart”,等待约 5-10 秒。

-

奇迹时刻:再次刷新页面,点击设置(齿轮图标),在语言栏选择“中文”。瞬间,那些可怕的

Latent Image变成了亲切的“潜空间图像”,VAE Decode变成了“VAE 解码”。

注意:虽然汉化能帮你理解,但我建议核心节点名称(如 CheckpointLoader)还是看英文。因为网上的教程和报错信息全是英文的,完全依赖汉化有时候反而会让你在搜教程时一脸懵逼。

3. 寻找“神级”工作流:如何利用 Search 筛选 2025 年高评分的 Flux/Video 模版

RunningHub 最值钱的不是算力,是它的社区(Community)。这里聚集了全球最聪明的“炼丹师”。

-

不要只搜关键词:新手只会在搜索栏打 “Girl” 或 “Landscape”。这是最低效的。

-

搜“技术栈”:2025 年,你应该搜 “Flux Pro”、“SVD 1.1” (Stable Video Diffusion)、“InstantID”(换脸神器)。

-

看“热度指标”:

-

Run Count (运行次数):如果一个工作流被运行了 10 万次,说明它极度稳定,不容易报错。

-

Remix Rate (二创率):这个指标高,说明这个工作流的可玩性强,容易出好图。

-

-

实战推荐:找到一个标签为

Flux-Dev-Upscale-Ultimate的工作流。这通常是目前画质的天花板组合,既有 Flux 的构图能力,又有 Ultimate SD Upscale 的细节放大能力。点击 “Run” 按钮,直接把这套价值千金的流水线复制到你的工作台。

四、 实战演练:复刻 Civitai 爆款图(附参数详解)

现在你的面前已经有了一套复杂的工作流,密密麻麻的连线像蜘蛛网一样。深呼吸,你不需要看懂每一根线。

在 RunningHub 上复刻一张 Civitai(C站)的神图,其实只需要三步。

1. 模型加载机制:为什么你不需要自己下载 20GB 的大模型?

在本地部署时,为了复刻一张图,你得去 C 站下载对应的 Checkpoint (大模型) 和 LoRA。现在的 Flux 模型动不动就 20GB+,下载一整晚,硬盘都要爆了。

在 RunningHub 上,请看工作流最左侧的 “Load Checkpoint” (模型加载器) 节点。

点击那个模型名称的下拉框。你会发现一个搜索栏。

-

操作:直接输入 Civitai 上那个模型名字的一部分,比如 “Juggernaut”。

-

魔法:系统会秒级索引。如果没有,RunningHub 通常支持 “Civitai URL Import”。你把 C 站的模型页面链接贴进去,后台服务器会以 10GB/s 的速度帮你把模型拉取到缓存区。

-

结论:你的硬盘空间占用是 0。这就是云原生的力量。

2. 节点连接逻辑:修改 Prompt 和 Seed 的正确姿势

看着那几百个节点,你只需要关注两个地方:输入 和 随机性。

-

CLIP Text Encode (Prompt):这是你输入咒语的地方。

-

绿色节点 通常是正向提示词(你想要的)。

-

红色节点 通常是负向提示词(你不想要的,比如 bad hands, mutation)。

-

2025 新趋势:对于 Flux 模型,其实不需要写太复杂的负向提示词,甚至留空都行。把精力花在正向描述上,用自然语言写(比如 “A cinematic photo of…”),而不是以前那种 “masterpiece, best quality” 的堆砌。

-

-

KSampler (采样器) 与 Seed:

-

这是出图的引擎。找到

seed这个选项。 -

Fixed (固定):如果你想微调同一张图(比如只改个发色),选这个。

-

Randomize (随机):如果你想抽卡,看不同的结果,选这个。

-

小白误区:很多人跑了一张好图,想再跑一张一样的,结果没固定 Seed,出来完全不一样的人,当场崩溃。切记:出好图的第一件事,是把 Seed 记下来!

-

3. 生成与下载:如何管理你的云端资产库,避免文件过期

点击屏幕右侧浮动菜单栏的大大的 “Queue Prompt” (排队) 按钮。

你会看到节点一个个亮起绿框,进度条飞快地跑动。大约 15-20 秒后(如果是 Flux),一张 2K 分辨率的大图就会出现在最右侧的 Save Image 节点里。

-

不要只右键另存为:虽然浏览器右键能保存,但那是压缩过的预览图。

-

正确姿势:点击 RunningHub 侧边栏的 “Gallery” (画廊) 或 “History”。这里保存的是服务器生成的无损原图(PNG 格式,且在此图片内隐写了完整的工作流元数据)。

-

重要警告:RunningHub 的免费存储空间通常是有限的(比如只保留最近 30 天的图片)。

-

动作:养成好习惯,每天结束“炼丹”后,批量选中 Gallery 里的好图,点击 “Download Zip” 打包下载回本地。

-

进阶:如果你会写 Python 脚本,RunningHub 提供了 API,可以把生成的图自动推送到你的 Google Drive,但这属于高阶玩法了,新手先学会手动打包。

-

五、 算账环节:RunningHub 真的比买显卡便宜吗?

到了大家最关心的环节了。很多“等等党”之所以还在犹豫,就是觉得:“买显卡虽然贵,但那是固定资产;用云端虽然爽,但那是无底洞。”

真的是这样吗?为了回答这个问题,我特意拉出了我 2024 年全年的账单,并对比了 2025 年最新的显卡市场价格。让我们用数据说话。

1. 计费模式详解:Credits(积分)消耗速度实测

RunningHub 的货币单位是 Credits。在 2025 年的标准汇率下,$10 美元 ≈ 10,000 Credits(如果你赶上黑五或者周年庆大促,这个比例还能更高)。

那么,生成一张图到底要多少钱?

我做了一组实测,基于 Flux.1 Dev 模型,分辨率 1024×1024,步数 20:

-

标准生成 (Standard Speed):消耗约 12 Credits。

-

换算成现金:约 $0.012 (一美分多一点,人民币不到一毛钱)。

-

-

极速模式 (Turbo/Fast):消耗约 20 Credits。

-

不需要排队,优先调度 H100 级别的算力,速度快 30%。

-

-

视频生成 (SVD/AnimateDiff):这是吞金兽。生成一段 4 秒的视频大约消耗 150-300 Credits。

结论:对于绝大多数只是画画图、发发小红书的用户来说,你也许多跑几次会心疼,但绝对比去网吧开黑便宜。

2. 场景模拟:重度用户 vs 轻度用户的年度账单对比

我们来算一笔账。假设你的目标是达到“RTX 4090 级别”的体验(目前市价约 $1800 – $2000,且电费惊人)。

-

用户 A(周末绘图师):

-

习惯:平时上班没空,周末玩两三个小时,每周生成 200 张图。

-

RunningHub 成本:200 张 x 12 Credits x 52 周 = 124,800 Credits。

-

年度花费:约 $120。

-

对比:你需要 15 年 的订阅费才能抵消一张 4090 的价格。而且 15 年后 4090 早就成电子垃圾了。

-

-

用户 B(职业炼丹师/接单狂魔):

-

习惯:每天都在跑图,还要跑视频,每个月消耗 50,000 Credits。

-

RunningHub 成本:$50/月 x 12 = $600/年。

-

对比:这时候买显卡似乎开始划算了?且慢! 你忘了算电费。一张满载的 4090 功耗 450W,加上 CPU 和其他硬件,一小时接近 1度电。如果你是全职跑图,一年电费就得几百刀。再加上折旧,其实云端依然有“不操心硬件损耗”的优势。

-

我的建议:如果你每月的预算低于 $30,无脑选 RunningHub。只有当你需要 24 小时挂机炼制自己的 LoRA 模型时,本地显卡才是刚需。

3. “白嫖”攻略:2025 年最新的每日签到与邀请奖励机制

RunningHub 的运营团队深谙“拼多多”之道。如果你脸皮够厚,或者够勤快,你甚至可以一分钱不花。

-

每日签到 (Daily Check-in):每天登录点一下,送 50-100 Credits。这虽然不多,但够你跑 5-8 张 Flux 试错图了。积少成多,一个月就是一顿免费的午餐。

-

Discord 社区赏金:关注他们的官方 Discord。每周都有 “Theme Challenge”(主题挑战赛)。只要你用他们的平台出图并投稿,哪怕没拿奖,作为参与奖通常也会发 500 Credits。如果拿了奖,那就是上万积分的入账。

-

邀请返利:这是大头。每邀请一个充值用户,你不仅能拿一次性奖励,还能获得他们消耗积分的 10%-20% 永久返点。我认识几个推特上的大佬,光靠发教程贴引流,账户里的积分早就多到下辈子都用不完了。

六、 常见报错与救命指南(FAQ)

只要是软件,就没有不崩的。RunningHub 虽然封装得很好,但偶尔也会发脾气。当遇到问题时,别急着在群里骂娘,先看看是不是下面这些情况。

1. “Queue 很久不反应”?教你分辨是服务器排队还是节点卡死

这是最搞心态的。你点了 “Queue”,按钮变灰了,但过了 5 分钟,进度条还是 0%。

-

情况 A:服务器排队 (Queued)

-

诊断:看右侧菜单栏顶部的 “Jobs” 数字。如果显示的 Position 是 5/100,说明前面有人在排队。

-

对策:2025 年的云端算力非常抢手。如果你是免费用户(Free Tier),晚高峰(北京时间 20:00-24:00)排队是常态。充个最低档的会员(通常 $9.9/月),立马插队,体验天差地别。

-

-

情况 B:节点卡死 (Stuck)

-

诊断:Position 显示 0/0,或者状态是 “Running”,但某个节点亮着绿框转圈转了 10 分钟不动。这通常是因为某个自定义节点(比如老版本的 ControlNet Preprocessor)在后台崩溃了,但没把错误信息吐出来。

-

对策:别傻等。直接点击顶部的 “Restart Server”。这不会扣你的积分(因为任务没完成)。重启后,尝试断开那个可疑节点的连接,或者换一个类似功能的节点替代。

-

2. 隐私与 NSFW 限制:RunningHub 的红线在哪里?

大家都是成年人,我知道你们想问什么。

-

官方态度:RunningHub 是有内容审查机制的 (NSFW Filter)。

-

触发机制:系统不会实时盯着你的屏幕看,但它会扫描你的 Prompt 和 生成的最终图像。如果检测到过于露骨的关键词或画面,任务会被强制终止,并弹窗警告。

-

后果:一次警告没事,连续多次触发红线会导致账号封禁。

-

老手忠告:如果你是做人体艺术研究或者是为了医学解剖学习(咳咳),请去租 RunPod 或者用本地部署。RunningHub 是 SaaS 服务,为了合规生存,它必须阉割这一块。别在危险的边缘试探,号没了积分也就没了。

3. 导出工作流到本地:如何把云端调试好的 JSON 拿回本地用

很多人把 RunningHub 当作“练兵场”:利用云端的便利性快速搭建测试工作流,调通了之后,想拿回公司的高配服务器上批量跑。

-

误区:很多人直接截图连线,然后回本地照着连。这太蠢了。

-

正确操作:

-

在 RunningHub 的工作流界面,点击右侧菜单栏的 “Save” (保存) 图标。

-

选择 “Save as API Format (JSON)” 或者直接下载 .json 文件。

-

把这个 JSON 文件拖进你本地的 ComfyUI 浏览器窗口。

-

-

注意:本地环境必须安装了和云端一模一样的自定义节点,否则加载时会报错红一片。这时候,神奇的 “ComfyUI Manager” 里的 “Install Missing Custom Nodes” 功能就能派上用场了,它会帮你把缺的插件全补齐。

数据评估

本站非猪ai导航提供的ComfyUI IndexTTS2都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由非猪ai导航实际控制,在2025年11月25日 上午12:25收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,非猪ai导航不承担任何责任。